您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹大數據中正則化方法、dropout、數據集擴增的示例分析,文中介紹的非常詳細,具有一定的參考價值,感興趣的小伙伴們一定要看完!

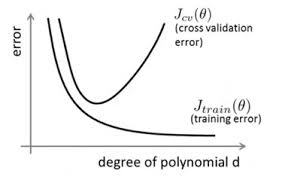

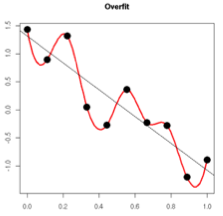

在訓練數據不夠多時,或者overtraining時,常常會導致overfitting(過擬合)。其直觀的表現如下圖所示,隨著訓練過程的進行,模型復雜度增加,在training data上的error漸漸減小,但是在驗證集上的error卻反而漸漸增大——因為訓練出來的網絡過擬合了訓練集,對訓練集外的數據卻不work。

為了防止overfitting,可以用的方法有很多,下文就將以此展開。有一個概念需要先說明,在機器學習算法中,我們常常將原始數據集分為三部分:training data、validation data,testing data。這個validation data是什么?它其實就是用來避免過擬合的,在訓練過程中,我們通常用它來確定一些超參數(比如根據validation data上的accuracy來確定early stopping的epoch大小、根據validation data確定learning rate等等)。那為啥不直接在testing data上做這些呢?因為如果在testing data做這些,那么隨著訓練的進行,我們的網絡實際上就是在一點一點地overfitting我們的testing data,導致最后得到的testing accuracy沒有任何參考意義。因此,training data的作用是計算梯度更新權重,validation data如上所述,testing data則給出一個accuracy以判斷網絡的好壞。

避免過擬合的方法有很多:early stopping、數據集擴增(Data augmentation)、正則化(Regularization)包括L1、L2(L2 regularization也叫weight decay),dropout。

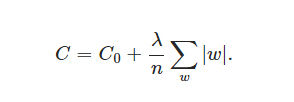

L2正則化就是在代價函數后面再加上一個正則化項:

C0代表原始的代價函數,后面那一項就是L2正則化項,它是這樣來的:所有參數w的平方的和,除以訓練集的樣本大小n。λ就是正則項系數,權衡正則項與C0項的比重。另外還有一個系數1/2,1/2經常會看到,主要是為了后面求導的結果方便,后面那一項求導會產生一個2,與1/2相乘剛好湊整。

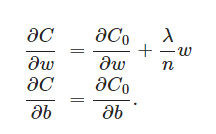

L2正則化項是怎么避免overfitting的呢?我們推導一下看看,先求導:

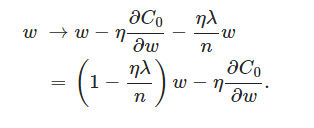

可以發現L2正則化項對b的更新沒有影響,但是對于w的更新有影響:

在不使用L2正則化時,求導結果中w前系數為1,現在w前面系數為 1?ηλ/n ,因為η、λ、n都是正的,所以 1?ηλ/n小于1,它的效果是減小w,這也就是權重衰減(weight decay)的由來。當然考慮到后面的導數項,w最終的值可能增大也可能減小。

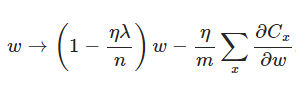

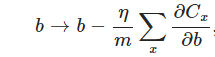

另外,需要提一下,對于基于mini-batch的隨機梯度下降,w和b更新的公式跟上面給出的有點不同:

對比上面w的更新公式,可以發現后面那一項變了,變成所有導數加和,乘以η再除以m,m是一個mini-batch中樣本的個數。

到目前為止,我們只是解釋了L2正則化項有讓w“變小”的效果,但是還沒解釋為什么w“變小”可以防止overfitting?一個所謂“顯而易見”的解釋就是:更小的權值w,從某種意義上說,表示網絡的復雜度更低,對數據的擬合剛剛好(這個法則也叫做奧卡姆剃刀),而在實際應用中,也驗證了這一點,L2正則化的效果往往好于未經正則化的效果。當然,對于很多人(包括我)來說,這個解釋似乎不那么顯而易見,所以這里添加一個稍微數學一點的解釋(引自知乎):

過擬合的時候,擬合函數的系數往往非常大,為什么?如下圖所示,過擬合,就是擬合函數需要顧忌每一個點,最終形成的擬合函數波動很大。在某些很小的區間里,函數值的變化很劇烈。這就意味著函數在某些小區間里的導數值(絕對值)非常大,由于自變量值可大可小,所以只有系數足夠大,才能保證導數值很大。

而正則化是通過約束參數的范數使其不要太大,所以可以在一定程度上減少過擬合情況。

L1 regularization

在原始的代價函數后面加上一個L1正則化項,即所有權重w的絕對值的和,乘以λ/n(這里不像L2正則化項那樣,需要再乘以1/2,具體原因上面已經說過。)

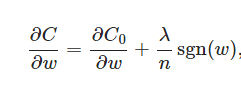

同樣先計算導數:

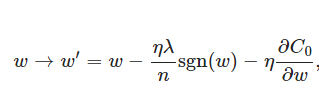

上式中sgn(w)表示w的符號。那么權重w的更新規則為:

比原始的更新規則多出了η * λ * sgn(w)/n這一項。當w為正時,更新后的w變小。當w為負時,更新后的w變大——因此它的效果就是讓w往0靠,使網絡中的權重盡可能為0,也就相當于減小了網絡復雜度,防止過擬合。

另外,上面沒有提到一個問題,當w為0時怎么辦?當w等于0時,|W|是不可導的,所以我們只能按照原始的未經正則化的方法去更新w,這就相當于去掉η*λ*sgn(w)/n這一項,所以我們可以規定sgn(0)=0,這樣就把w=0的情況也統一進來了。(在編程的時候,令sgn(0)=0,sgn(w>0)=1,sgn(w<0)=-1)

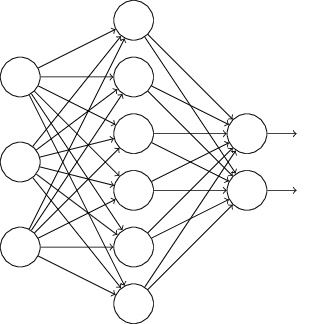

L1、L2正則化是通過修改代價函數來實現的,而Dropout則是通過修改神經網絡本身來實現的,它是在訓練網絡時用的一種技巧(trike)。它的流程如下:

假設我們要訓練上圖這個網絡,在訓練開始時,我們隨機地“刪除”一半的隱層單元,視它們為不存在,得到如下的網絡:

保持輸入輸出層不變,按照BP算法更新上圖神經網絡中的權值(虛線連接的單元不更新,因為它們被“臨時刪除”了)。

以上就是一次迭代的過程,在第二次迭代中,也用同樣的方法,只不過這次刪除的那一半隱層單元,跟上一次刪除掉的肯定是不一樣的,因為我們每一次迭代都是“隨機”地去刪掉一半。第三次、第四次……都是這樣,直至訓練結束。

以上就是Dropout,它為什么有助于防止過擬合呢?可以簡單地這樣解釋,運用了dropout的訓練過程,相當于訓練了很多個只有半數隱層單元的神經網絡(后面簡稱為“半數網絡”),每一個這樣的半數網絡,都可以給出一個分類結果,這些結果有的是正確的,有的是錯誤的。隨著訓練的進行,大部分半數網絡都可以給出正確的分類結果,那么少數的錯誤分類結果就不會對最終結果造成大的影響。

更加深入地理解,可以看看Hinton和Alex兩牛2012的論文《ImageNet Classification with Deep Convolutional Neural Networks》

“有時候不是因為算法好贏了,而是因為擁有更多的數據才贏了。”

不記得原話是哪位大牛說的了,hinton?從中可見訓練數據有多么重要,特別是在深度學習方法中,更多的訓練數據,意味著可以用更深的網絡,訓練出更好的模型。

既然這樣,收集更多的數據不就行啦?如果能夠收集更多可以用的數據,當然好。但是很多時候,收集更多的數據意味著需要耗費更多的人力物力,有弄過人工標注的同學就知道,效率特別低,簡直是粗活。

所以,可以在原始數據上做些改動,得到更多的數據,以圖片數據集舉例,可以做各種變換,如:

將原始圖片旋轉一個小角度

添加隨機噪聲

一些有彈性的畸變(elastic distortions),論文《Best practices for convolutional neural networks applied to visual document analysis》對MNIST做了各種變種擴增。

截取(crop)原始圖片的一部分。比如DeepID中,從一副人臉圖中,截取出了100個小patch作為訓練數據,極大地增加了數據集。

以上是“大數據中正則化方法、dropout、數據集擴增的示例分析”這篇文章的所有內容,感謝各位的閱讀!希望分享的內容對大家有幫助,更多相關知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。