溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

這篇文章將為大家詳細講解有關pytorch中如何計算交叉熵損失,小編覺得挺實用的,因此分享給大家做個參考,希望大家閱讀完這篇文章后可以有所收獲。

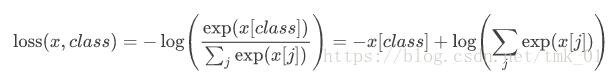

公式

首先需要了解CrossEntropyLoss的計算過程,交叉熵的函數是這樣的:

其中,其中yi表示真實的分類結果。這里只給出公式,關于CrossEntropyLoss的其他詳細細節請參照其他博文。

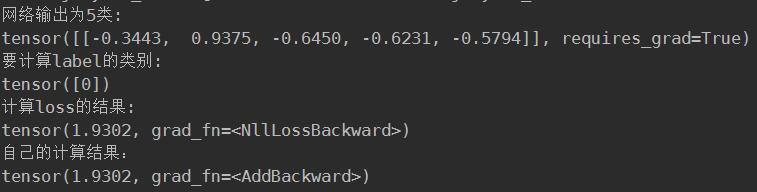

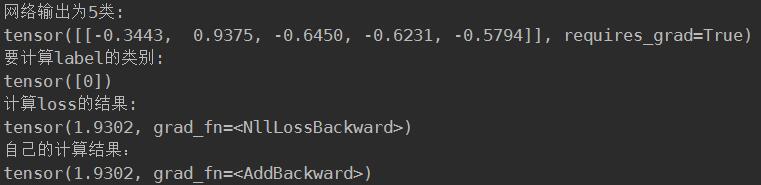

測試代碼(一維)

import torch

import torch.nn as nn

import math

criterion = nn.CrossEntropyLoss()

output = torch.randn(1, 5, requires_grad=True)

label = torch.empty(1, dtype=torch.long).random_(5)

loss = criterion(output, label)

print("網絡輸出為5類:")

print(output)

print("要計算label的類別:")

print(label)

print("計算loss的結果:")

print(loss)

first = 0

for i in range(1):

first = -output[i][label[i]]

second = 0

for i in range(1):

for j in range(5):

second += math.exp(output[i][j])

res = 0

res = (first + math.log(second))

print("自己的計算結果:")

print(res)

測試代碼(多維)

import torch

import torch.nn as nn

import math

criterion = nn.CrossEntropyLoss()

output = torch.randn(3, 5, requires_grad=True)

label = torch.empty(3, dtype=torch.long).random_(5)

loss = criterion(output, label)

print("網絡輸出為3個5類:")

print(output)

print("要計算loss的類別:")

print(label)

print("計算loss的結果:")

print(loss)

first = [0, 0, 0]

for i in range(3):

first[i] = -output[i][label[i]]

second = [0, 0, 0]

for i in range(3):

for j in range(5):

second[i] += math.exp(output[i][j])

res = 0

for i in range(3):

res += (first[i] + math.log(second[i]))

print("自己的計算結果:")

print(res/3)

nn.CrossEntropyLoss()中的計算方法

注意:在計算CrossEntropyLosss時,真實的label(一個標量)被處理成onehot編碼的形式。

在pytorch中,CrossEntropyLoss計算公式為:

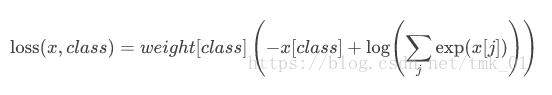

CrossEntropyLoss帶權重的計算公式為(默認weight=None):

關于“pytorch中如何計算交叉熵損失”這篇文章就分享到這里了,希望以上內容可以對大家有一定的幫助,使各位可以學到更多知識,如果覺得文章不錯,請把它分享出去讓更多的人看到。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。