您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹“k8s部署redis集群實現的方法是什么”,在日常操作中,相信很多人在k8s部署redis集群實現的方法是什么問題上存在疑惑,小編查閱了各式資料,整理出簡單好用的操作方法,希望對大家解答”k8s部署redis集群實現的方法是什么”的疑惑有所幫助!接下來,請跟著小編一起來學習吧!

nfs

# 服務端

# 1.安裝

yum -y install nfs-utils # nfs文件系統

yum -y install rpcbind # rpc協議

# 2.配置(需要共享的文件夾)

vi /etc/exports

/opt/nfs/pv1 *(rw,sync,no_subtree_check,no_root_squash)

/opt/nfs/pv2 *(rw,sync,no_subtree_check,no_root_squash)

/opt/nfs/pv3 *(rw,sync,no_subtree_check,no_root_squash)

/opt/nfs/pv4 *(rw,sync,no_subtree_check,no_root_squash)

/opt/nfs/pv5 *(rw,sync,no_subtree_check,no_root_squash)

/opt/nfs/pv6 *(rw,sync,no_subtree_check,no_root_squash)

# 3.創建文件夾

mkdir -p /opt/nfs/pv{1..6}

# 4.更新配置并重啟nfs服務

exportfs -r #更新配置

systemctl restart rpcbind

systemctl restart nfs

systemctl enable nfs #開機啟動

systemctl enable rpcbind

# 5.驗證

showmount -e 192.168.4.xx #服務端驗證NFS共享

> Export list for 192.168.4.xx:

/opt/nfs/pv6 *

/opt/nfs/pv5 *

/opt/nfs/pv4 *

/opt/nfs/pv3 *

/opt/nfs/pv2 *

/opt/nfs/pv1 *

rpcinfo -p #查看端口

# 客戶端

yum -y install nfs-utils

systemctl restart nfs

systemctl enable nfs #開機啟動這里說一下,為什么要安裝nfs?

是為了下面創建SC,PV做準備,PV需要使用nfs服務器。

StorageClass:簡稱sc,存儲類,是k8s平臺為存儲提供商提供存儲接入的一種聲明。通過sc和相應的存儲插件(csi)為容器應用提供持久存儲卷的能力。

vi redis-sc.yaml

apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: redis-sc provisioner: nfs-storage

名稱為redis-sc

執行創建sc:

kubectl apply -f redis-sc.yaml > storageclass.storage.k8s.io/redis-sc created

通過kuboard查看:

PersistentVolume簡稱pv,持久化存儲,是k8s為云原生應用提供一種擁有獨立生命周期的、用戶可管理的存儲的抽象設計。

vi redis-pv.yaml

apiVersion: v1 kind: PersistentVolume metadata: name: nfs-pv1 spec: storageClassName: redis-sc capacity: storage: 200M accessModes: - ReadWriteMany nfs: server: 192.168.4.xx path: "/opt/nfs/pv1"

名稱為nfs-pv1,對應的storageClassName為redis-sc,capacity容器200M,accessModes訪問模式可被多節點讀寫

對應nfs服務器192.168.4.xx,對應文件夾路徑/opt/nfs/pv1(對應上面安裝nfs服務器)

以此類推,我們創建6個pv......

執行創建sc:

kubectl apply -f redis-pv.yaml > persistentvolume/nfs-pv1 created persistentvolume/nfs-pv2 created persistentvolume/nfs-pv3 created persistentvolume/nfs-pv4 created persistentvolume/nfs-pv5 created persistentvolume/nfs-pv6 created

通過kuboard查看:

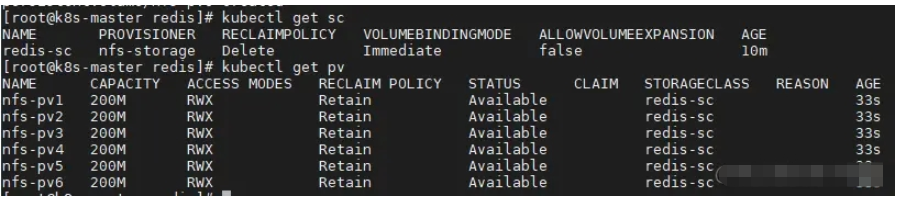

通過kubectl查看:kubectl get sc、kubectl get pv

這里說一下,為什么要創建SC,PV?

因為redis集群,最終需要對應的文件有,redis.conf、nodes.conf、data

由此可見,這些文件每個節點,都得對應有自己得文件夾。

當然redis.conf可以是一個相同得,其他兩個,就肯定是不一樣得。

如果使用掛載文件夾即是 Volume 的情況部署一個pod,很明顯,是不能滿足的。

當然,你部署多個不一樣的pod,也是可以做到,但是就得寫6個部署yaml文件,后期維護也很復雜。

最好的效果是,寫一個部署yaml文件,然后有6個replicas副本,就對應了我們redis集群(三主三從)。

那一個pod,再使用Volume掛載文件夾,這個只能是一個文件夾,是無法做到6個pod對應不同的文件夾。

所以這里,就引出了SC、PV了。

使用SC、PV就可以實現,這6個pod啟動,就對應上我們創建的6個PV,那就實現了redis.conf、nodes.conf、data,這三個文件,存放的路徑,就是不一樣的路徑了。

哈哈,說了,那么多,不知道,大家明不明白,不明白的可以繼續往下看,或者自己部署實操一下,估計你就能明白,為啥要這么干了?

RC、Deployment、DaemonSet都是面向無狀態的服務,它們所管理的Pod的IP、名字,啟停順序等都是隨機的,而StatefulSet是什么?顧名思義,有狀態的集合,管理所有有狀態的服務,比如MySQL、MongoDB集群等。

StatefulSet本質上是Deployment的一種變體,在v1.9版本中已成為GA版本,它為了解決有狀態服務的問題,它所管理的Pod擁有固定的Pod名稱,啟停順序,在StatefulSet中,Pod名字稱為網絡標識(hostname),還必須要用到共享存儲。

在Deployment中,與之對應的服務是service,而在StatefulSet中與之對應的headless service,headless service,即無頭服務,與service的區別就是它沒有Cluster IP,解析它的名稱時將返回該Headless Service對應的全部Pod的Endpoint列表。

除此之外,StatefulSet在Headless Service的基礎上又為StatefulSet控制的每個Pod副本創建了一個DNS域名,這個域名的格式為:

$(pod.name).$(headless server.name).${namespace}.svc.cluster.local也即是說,對于有狀態服務,我們最好使用固定的網絡標識(如域名信息)來標記節點,當然這也需要應用程序的支持(如Zookeeper就支持在配置文件中寫入主機域名)。

StatefulSet基于Headless Service(即沒有Cluster IP的Service)為Pod實現了穩定的網絡標志(包括Pod的hostname和DNS Records),在Pod重新調度后也保持不變。同時,結合PV/PVC,StatefulSet可以實現穩定的持久化存儲,就算Pod重新調度后,還是能訪問到原先的持久化數據。

以下為使用StatefulSet部署Redis的架構,無論是Master還是Slave,都作為StatefulSet的一個副本,并且數據通過PV進行持久化,對外暴露為一個Service,接受客戶端請求。

Headless service是StatefulSet實現穩定網絡標識的基礎。

vi redis-hs.yaml

--- apiVersion: v1 kind: Service metadata: labels: k8s.kuboard.cn/layer: db k8s.kuboard.cn/name: redis name: redis-hs namespace: jxbp spec: ports: - name: nnbary port: 6379 protocol: TCP targetPort: 6379 selector: k8s.kuboard.cn/layer: db k8s.kuboard.cn/name: redis clusterIP: None

命名空間為:jxbp,名稱為:redis-hs

執行:

kubectl apply -f redis-hs.yaml > service/redis-hs created

網絡訪問:pod名稱.headless名稱.namespace名稱.svc.cluster.local

即:pod名稱.redis-hs.jxbp.svc.cluster.local

創建好Headless service后,就可以利用StatefulSet創建Redis 集群節點,這也是本文的核心內容。

vi redis.yaml

apiVersion: apps/v1 kind: StatefulSet metadata: name: redis namespace: jxbp labels: k8s.kuboard.cn/layer: db k8s.kuboard.cn/name: redis spec: replicas: 6 selector: matchLabels: k8s.kuboard.cn/layer: db k8s.kuboard.cn/name: redis serviceName: redis template: metadata: labels: k8s.kuboard.cn/layer: db k8s.kuboard.cn/name: redis spec: terminationGracePeriodSeconds: 20 containers: - name: redis image: 192.168.4.xx/jxbp/redis:6.2.6 ports: - name: redis containerPort: 6379 protocol: "TCP" - name: cluster containerPort: 16379 protocol: "TCP" volumeMounts: - name: "redis-conf" mountPath: "/etc/redis/redis.conf" - name: "redis-data" mountPath: "/data" volumes: - name: "redis-conf" hostPath: path: "/opt/redis/conf/redis.conf" type: FileOrCreate volumeClaimTemplates: - metadata: name: redis-data spec: accessModes: [ "ReadWriteMany" ] resources: requests: storage: 200M storageClassName: redis-sc

名稱為:redis,對應的鏡像為:redis:6.2.6,

掛載的文件:宿主機的/opt/redis/conf/redis.conf到redis容器的/etc/redis/redis.conf(redis.conf配置文件如下所示)

PVC存儲卷聲明模板volumeClaimTemplates,指定了名稱為redis-sc的SC(storageClassName)

由于之前SC綁定了PV,所以這里的PVC和PV,就能一 一對應綁定上了。

PV和PVC的關系,是一 一綁定的。如果這里不指定SC,那就會導致,PVC綁定PV,是一個混亂的過程,隨機綁定PV了。

redis.conf

# 一般配置 bind 0.0.0.0 port 6379 daemonize no requirepass jxbd # 集群配置 cluster-enabled yes cluster-config-file nodes.conf cluster-node-timeout 5000

執行:

kubectl apply -f redis.yaml

由上操作,我們已經創建好redis的6個副本了。

到此,關于“k8s部署redis集群實現的方法是什么”的學習就結束了,希望能夠解決大家的疑惑。理論與實踐的搭配能更好的幫助大家學習,快去試試吧!若想繼續學習更多相關知識,請繼續關注億速云網站,小編會繼續努力為大家帶來更多實用的文章!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。