您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

今天小編給大家分享一下linux系統影響tcp連接數的因素是什么的相關知識點,內容詳細,邏輯清晰,相信大部分人都還太了解這方面的知識,所以分享這篇文章給大家參考一下,希望大家閱讀完這篇文章后有所收獲,下面我們一起來了解一下吧。

linux系統中影響tcp連接數的主要因素是內存和允許的文件描述符個數,因為每個tcp連接都要占用一定內存,且每個socket就是一個文件描述符,另外1024以下的端口通常為保留端口。

在tcp應用中,server事先在某個固定端口監聽,client主動發起連接,經過三次握手后建立tcp連接。那么對單機,其最大并發tcp連接數是多少呢?

如何標識一個TCP連接

在確定最大連接數之前,先來看看系統如何標識一個tcp連接。系統用一個4四元組來唯一標識一個TCP連接:{localip, localport,remoteip,remoteport}。

client最大tcp連接數

client每次發起tcp連接請求時,除非綁定端口,通常會讓系統選取一個空閑的本地端口(local port),該端口是獨占的,不能和其他tcp連接共享。tcp端口的數據類型是unsigned short,因此本地端口個數最大只有65536,端口0有特殊含義,不能使用,這樣可用端口最多只有65535,所以在全部作為client端的情況下,一個client最大tcp連接數為65535,這些連接可以連到不同的serverip。

server最大tcp連接數

server通常固定在某個本地端口上監聽,等待client的連接請求。不考慮地址重用(unix的SO_REUSEADDR選項)的情況下,即使server端有多個ip,本地監聽端口也是獨占的,因此server端tcp連接4元組中只有remoteip(也就是clientip)和remote port(客戶端port)是可變的,因此最大tcp連接為客戶端ip數×客戶端port數,對IPV4,不考慮ip地址分類等因素,最大tcp連接數約為2的32次方(ip數)×2的16次方(port數),也就是server端單機最大tcp連接數約為2的48次方。

實際的tcp連接數

上面給出的是理論上的單機最大連接數,在實際環境中,受到機器資源、操作系統等的限制,特別是sever端,其最大并發tcp連接數遠不能達到理論上限。在unix/linux下限制連接數的主要因素是內存和允許的文件描述符個數(每個tcp連接都要占用一定內存,每個socket就是一個文件描述符),另外1024以下的端口通常為保留端口。在默認2.6內核配置下,經過試驗,每個socket占用內存在15~20k之間。

所以,對server端,通過增加內存、修改最大文件描述符個數等參數,單機最大并發TCP連接數超過10萬,甚至上百萬是沒問題的。

這明顯是進入了思維的誤區,65535是指可用的端口總數,并不代表服務器同時只能接受65535個并發連接。

舉個例子:

我們做了一個網站,綁定的是TCP的80端口,結果是所有訪問這個網站的用戶都是通過服務器的80端口訪問,而不是其他端口。可見端口是可以復用的。即使Linux服務器只在80端口偵聽服務, 也允許有10萬、100萬個用戶連接服務器。Linux系統不會限制連接數至于服務器能不能承受住這么多的連接,取決于服務器的硬件配置、軟件架構及優化。

我們知道兩個進程如果需要進行通訊最基本的一個前提是:能夠唯一的標示一個進程。在本地進程通訊中我們可以使用PID來唯一標示一個進程,但PID只在本地唯一,網絡中的兩個進程PID沖突幾率很大。

這時候就需要另辟它徑了,IP地址可以唯一標示主機,而TCP層協議和端口號可以唯一標示主機的一個進程,這樣可以利用IP地址+協議+端口號唯一標示網絡中的一個進程。

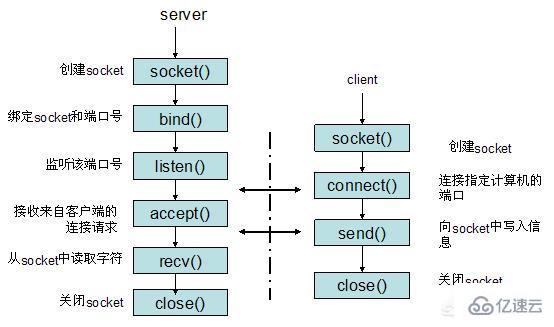

能夠唯一標示網絡中的進程后,它們就可以利用socket進行通信了。socket(套接字)是在應用層和傳輸層之間的一個抽象層,它把TCP/IP層復雜的操作抽象為幾個簡單的接口供應用層調用已實現進程在網絡中通信。

socket源自Unix,是一種"打開—讀/寫—關閉"模式的實現,服務器和客戶端各自維護一個"文件",在建立連接打開后,可以向自己文件寫入內容供對方讀取或者讀取對方內容,通訊結束時關閉文件。

唯一能夠確定一個連接有4個東西:

1. 服務器的IP

2. 服務器的Port

3. 客戶端的IP

4. 客戶端的Port

服務器的IP和Port可以保持不變,只要客戶端的IP和Port彼此不同就可以確定一個連接數。

一個socket是可以建立多個連接的,一個TCP連接的標記為一個四元組(source_ip, source_port, destination_ip, destination_port),即(源IP,源端口,目的IP,目的端口)四個元素的組合。只要四個元素的組合中有一個元素不一樣,那就可以區別不同的連接。

舉個例子:

->你的主機IP地址是1.1.1.1, 在8080端口監聽

->當一個來自 2.2.2.2 發來一條連接請求,端口為5555。這條連接的四元組為(1.1.1.1, 8080, 2.2.2.2, 5555)

->這時2.2.2.2又發來第二條連接請求,端口為6666。新連接的四元組為(1.1.1.1, 8080, 2.2.2.2, 6666)

那么,你主機的8080端口建立了兩條連接;

->(2.2.2.2)發來的第三條連接請求,端口為5555(或6666)。第三條連接的請求就無法建立,因為沒有辦法區分于上面兩條連接。

同理,可以在同一個端口號和IP地址上綁定一個TCP socket和一個UDP socket

因為端口號雖然一樣,但由于協議不一樣,所以端口是完全獨立的。

TCP/UDP一般采用五元組來定位一個連接:

source_ip, source_port, destination_ip, destination_port, protocol_type

即(源IP,源端口,目的IP,目的端口,協議號)

綜上所述,服務器的并發數并不是由TCP的65535個端口決定的。服務器同時能夠承受的并發數是由帶寬、硬件、程序設計等多方面因素決定的。

所以也就能理解淘寶、騰訊、頭條、百度、新浪、嗶嗶嗶嗶等為什么能夠承受住每秒種幾億次的并發訪問,是因為他們采用的是服務器集群。服務器集群分布在全國各地的大型機房,當訪問量小的時候會關閉一些服務器,當訪問量大的時候回不斷的開啟新的服務器。

在linux下編寫網絡服務器程序的朋友肯定都知道每一個tcp連接都要占一個文件描述符,一旦這個文件描述符使用完了,新的連接到來返回給我們的錯誤是“Socket/File:Can't open so many files”。

這時你需要明白操作系統對可以打開的最大文件數的限制。

進程限制

執行 ulimit -n 輸出 1024,說明對于一個進程而言最多只能打開1024個文件,所以你要采用此默認配置最多也就可以并發上千個TCP連接。

臨時修改:ulimit -n 1000000,但是這種臨時修改只對當前登錄用戶目前的使用環境有效,系統重啟或用戶退出后就會失效。

重啟后失效的修改(不過我在CentOS 6.5下測試,重啟后未發現失效):編輯 /etc/security/limits.conf 文件, 修改后內容為

* soft nofile 1000000

* hard nofile 1000000

永久修改:編輯/etc/rc.local,在其后添加如下內容

ulimit -SHn 1000000

全局限制

執行 cat /proc/sys/fs/file-nr 輸出 9344 0 592026,分別為:1.已經分配的文件句柄數,2.已經分配但沒有使用的文件句柄數,3.最大文件句柄數。但在kernel 2.6版本中第二項的值總為0,這并不是一個錯誤,它實際上意味著已經分配的文件描述符無一浪費的都已經被使用了 。

我們可以把這個數值改大些,用 root 權限修改 /etc/sysctl.conf 文件:

fs.file-max = 1000000

net.ipv4.ip_conntrack_max = 1000000

net.ipv4.netfilter.ip_conntrack_max = 1000000

操作系統上端口號1024以下是系統保留的,從1024-65535是用戶使用的。由于每個TCP連接都要占一個端口號,所以我們最多可以有60000多個并發連接。我想有這種錯誤思路朋友不在少數吧?(其中我過去就一直這么認為)

我們來分析一下吧

如何標識一個TCP連接:系統用一個4四元組來唯一標識一個TCP連接:{local ip, local port,remote ip,remote port}。好吧,我們拿出《UNIX網絡編程:卷一》第四章中對accept的講解來看看概念性的東西,第二個參數cliaddr代表了客戶端的ip地址和端口號。而我們作為服務端實際只使用了bind時這一個端口,說明端口號65535并不是并發量的限制。

server最大tcp連接數:server通常固定在某個本地端口上監聽,等待client的連接請求。不考慮地址重用(unix的SO_REUSEADDR選項)的情況下,即使server端有多個ip,本地監聽端口也是獨占的,因此server端tcp連接4元組中只有remote ip(也就是client ip)和remote port(客戶端port)是可變的,因此最大tcp連接為客戶端ip數×客戶端port數,對IPV4,不考慮ip地址分類等因素,最大tcp連接數約為2的32次方(ip數)×2的16次方(port數),也就是server端單機最大tcp連接數約為2的48次方。

在Linux平臺上,無論編寫客戶端程序還是服務端程序,在進行高并發TCP連接處理時,最高的并發數量都要受到系統對用戶單一進程同時可打開文件數量的限制(這是因為系統為每個TCP連接都要創建一個socket句柄,每個socket句柄同時也是一個文件句柄)。可使用ulimit命令查看系統允許當前用戶進程打開的文件數限制:

[speng@as4 ~]$ ulimit -n

1024

這表示當前用戶的每個進程最多允許同時打開1024個文件,這1024個文件中還得除去每個進程必然打開的標準輸入,標準輸出,標準錯誤,服務器監聽 socket,進程間通訊的unix域socket等文件,那么剩下的可用于客戶端socket連接的文件數就只有大概1024-10=1014個左右。也就是說缺省情況下,基于Linux的通訊程序最多允許同時1014個TCP并發連接。

對于想支持更高數量的TCP并發連接的通訊處理程序,就必須修改Linux對當前用戶的進程同時打開的文件數量的軟限制(soft limit)和硬限制(hardlimit)。其中軟限制是指Linux在當前系統能夠承受的范圍內進一步限制用戶同時打開的文件數;硬限制則是根據系統硬件資源狀況(主要是系統內存)計算出來的系統最多可同時打開的文件數量。通常軟限制小于或等于硬限制。

修改上述限制的最簡單的辦法就是使用ulimit命令:

[speng@as4 ~]$ ulimit -n

上述命令中,在中指定要設置的單一進程允許打開的最大文件數。如果系統回顯類似于“Operation notpermitted”之類的話,說明上述限制修改失敗,實際上是因為在中指定的數值超過了Linux系統對該用戶打開文件數的軟限制或硬限制。因此,就需要修改Linux系統對用戶的關于打開文件數的軟限制和硬限制。

第一步,修改/etc/security/limits.conf文件,在文件中添加如下行:

...

# End of file

speng soft nofile 10240

speng hard nofile 10240

root soft nofile 65535

root hard nofile 65535

* soft nofile 65535

* hard nofile 65535

[test@iZwz9e1dh2nweaex8ob5b7Z config]$

其中speng指定了要修改哪個用戶的打開文件數限制,可用’*'號表示修改所有用戶的限制;soft或hard指定要修改軟限制還是硬限制;10240則指定了想要修改的新的限制值,即最大打開文件數(請注意軟限制值要小于或等于硬限制)。修改完后保存文件。

第二步,修改/etc/pam.d/login文件,在文件中添加如下行:

session required /lib/security/pam_limits.so

這是告訴Linux在用戶完成系統登錄后,應該調用pam_limits.so模塊來設置系統對該用戶可使用的各種資源數量的最大限制(包括用戶可打開的最大文件數限制),而pam_limits.so模塊就會從/etc/security/limits.conf文件中讀取配置來設置這些限制值。修改完后保存此文件。

第三步,查看Linux系統級的最大打開文件數限制,使用如下命令:

[speng@as4 ~]$ cat /proc/sys/fs/file-max

12158

這表明這臺Linux系統最多允許同時打開(即包含所有用戶打開文件數總和)12158個文件,是Linux系統級硬限制,所有用戶級的打開文件數限制都不應超過這個數值。通常這個系統級硬限制是Linux系統在啟動時根據系統硬件資源狀況計算出來的最佳的最大同時打開文件數限制,如果沒有特殊需要,不應該修改此限制,除非想為用戶級打開文件數限制設置超過此限制的值。修改此硬限制的方法是修改/etc/rc.local腳本,在腳本中添加如下行:

echo 22158 > /proc/sys/fs/file-max

這是讓Linux在啟動完成后強行將系統級打開文件數硬限制設置為22158。修改完后保存此文件。

完成上述步驟后重啟系統,一般情況下就可以將Linux系統對指定用戶的單一進程允許同時打開的最大文件數限制設為指定的數值。如果重啟后用 ulimit-n命令查看用戶可打開文件數限制仍然低于上述步驟中設置的最大值,這可能是因為在用戶登錄腳本/etc/profile中使用ulimit -n命令已經將用戶可同時打開的文件數做了限制。由于通過ulimit-n修改系統對用戶可同時打開文件的最大數限制時,新修改的值只能小于或等于上次 ulimit-n設置的值,因此想用此命令增大這個限制值是不可能的。所以,如果有上述問題存在,就只能去打開/etc/profile腳本文件,在文件中查找是否使用了ulimit-n限制了用戶可同時打開的最大文件數量,如果找到,則刪除這行命令,或者將其設置的值改為合適的值,然后保存文件,用戶退出并重新登錄系統即可。

通過上述步驟,就為支持高并發TCP連接處理的通訊處理程序解除關于打開文件數量方面的系統限制。

在Linux上編寫支持高并發TCP連接的客戶端通訊處理程序時,有時會發現盡管已經解除了系統對用戶同時打開文件數的限制,但仍會出現并發TCP連接數增加到一定數量時,再也無法成功建立新的TCP連接的現象。出現這種現在的原因有多種。

第一種原因可能是因為Linux網絡內核對本地端口號范圍有限制。此時,進一步分析為什么無法建立TCP連接,會發現問題出在connect()調用返回失敗,查看系統錯誤提示消息是“Can’t assign requestedaddress”。同時,如果在此時用tcpdump工具監視網絡,會發現根本沒有TCP連接時客戶端發SYN包的網絡流量。這些情況說明問題在于本地Linux系統內核中有限制。其實,問題的根本原因在于Linux內核的TCP/IP協議實現模塊對系統中所有的客戶端TCP連接對應的本地端口號的范圍進行了限制(例如,內核限制本地端口號的范圍為1024~32768之間)。當系統中某一時刻同時存在太多的TCP客戶端連接時,由于每個TCP客戶端連接都要占用一個唯一的本地端口號(此端口號在系統的本地端口號范圍限制中),如果現有的TCP客戶端連接已將所有的本地端口號占滿,則此時就無法為新的TCP客戶端連接分配一個本地端口號了,因此系統會在這種情況下在connect()調用中返回失敗,并將錯誤提示消息設為“Can’t assignrequested address”。有關這些控制邏輯可以查看Linux內核源代碼,以linux2.6內核為例,可以查看tcp_ipv4.c文件中如下函數:

static int tcp_v4_hash_connect(struct sock *sk)

請注意上述函數中對變量sysctl_local_port_range的訪問控制。變量sysctl_local_port_range的初始化則是在tcp.c文件中的如下函數中設置:

void __init tcp_init(void)

內核編譯時默認設置的本地端口號范圍可能太小,因此需要修改此本地端口范圍限制。

第一步,修改/etc/sysctl.conf文件,在文件中添加如下行:

net.ipv4.ip_local_port_range = 1024 65000

這表明將系統對本地端口范圍限制設置為1024~65000之間。請注意,本地端口范圍的最小值必須大于或等于1024;而端口范圍的最大值則應小于或等于65535。修改完后保存此文件。

第二步,執行sysctl命令:

[speng@as4 ~]$ sysctl -p

如果系統沒有錯誤提示,就表明新的本地端口范圍設置成功。如果按上述端口范圍進行設置,則理論上單獨一個進程最多可以同時建立60000多個TCP客戶端連接。

第二種無法建立TCP連接的原因可能是因為Linux網絡內核的IP_TABLE防火墻對最大跟蹤的TCP連接數有限制。此時程序會表現為在 connect()調用中阻塞,如同死機,如果用tcpdump工具監視網絡,也會發現根本沒有TCP連接時客戶端發SYN包的網絡流量。由于 IP_TABLE防火墻在內核中會對每個TCP連接的狀態進行跟蹤,跟蹤信息將會放在位于內核內存中的conntrackdatabase中,這個數據庫的大小有限,當系統中存在過多的TCP連接時,數據庫容量不足,IP_TABLE無法為新的TCP連接建立跟蹤信息,于是表現為在connect()調用中阻塞。此時就必須修改內核對最大跟蹤的TCP連接數的限制,方法同修改內核對本地端口號范圍的限制是類似的:

第一步,修改/etc/sysctl.conf文件,在文件中添加如下行:

net.ipv4.ip_conntrack_max = 10240

這表明將系統對最大跟蹤的TCP連接數限制設置為10240。請注意,此限制值要盡量小,以節省對內核內存的占用。

第二步,執行sysctl命令:

[speng@as4 ~]$ sysctl -p

如果系統沒有錯誤提示,就表明系統對新的最大跟蹤的TCP連接數限制修改成功。如果按上述參數進行設置,則理論上單獨一個進程最多可以同時建立10000多個TCP客戶端連接。

在Linux上編寫高并發TCP連接應用程序時,必須使用合適的網絡I/O技術和I/O事件分派機制。

可用的I/O技術有同步I/O,非阻塞式同步I/O(也稱反應式I/O),以及異步I/O。《BIO,NIO,AIO的理解》

在高TCP并發的情形下,如果使用同步I/O,這會嚴重阻塞程序的運轉,除非為每個TCP連接的I/O創建一個線程。但是,過多的線程又會因系統對線程的調度造成巨大開銷。因此,在高TCP并發的情形下使用同步 I/O是不可取的,這時可以考慮使用非阻塞式同步I/O或異步I/O。非阻塞式同步I/O的技術包括使用select(),poll(),epoll等機制。異步I/O的技術就是使用AIO。

從I/O事件分派機制來看,使用select()是不合適的,因為它所支持的并發連接數有限(通常在1024個以內)。如果考慮性能,poll()也是不合適的,盡管它可以支持的較高的TCP并發數,但是由于其采用“輪詢”機制,當并發數較高時,其運行效率相當低,并可能存在I/O事件分派不均,導致部分TCP連接上的I/O出現“饑餓”現象。而如果使用epoll或AIO,則沒有上述問題(早期Linux內核的AIO技術實現是通過在內核中為每個 I/O請求創建一個線程來實現的,這種實現機制在高并發TCP連接的情形下使用其實也有嚴重的性能問題。但在最新的Linux內核中,AIO的實現已經得到改進)。

綜上所述,在開發支持高并發TCP連接的Linux應用程序時,應盡量使用epoll或AIO技術來實現并發的TCP連接上的I/O控制,這將為提升程序對高并發TCP連接的支持提供有效的I/O保證。

內核參數sysctl.conf的優化

/etc/sysctl.conf 是用來控制linux網絡的配置文件,對于依賴網絡的程序(如web服務器和cache服務器)非常重要,RHEL默認提供的最好調整。

推薦配置(把原/etc/sysctl.conf內容清掉,把下面內容復制進去):

net.ipv4.ip_local_port_range = 1024 65536

net.core.rmem_max=16777216

net.core.wmem_max=16777216

net.ipv4.tcp_rmem=4096 87380 16777216

net.ipv4.tcp_wmem=4096 65536 16777216

net.ipv4.tcp_fin_timeout = 10

net.ipv4.tcp_tw_recycle = 1

net.ipv4.tcp_timestamps = 0

net.ipv4.tcp_window_scaling = 0

net.ipv4.tcp_sack = 0

net.core.netdev_max_backlog = 30000

net.ipv4.tcp_no_metrics_save=1

net.core.somaxconn = 262144

net.ipv4.tcp_syncookies = 0

net.ipv4.tcp_max_orphans = 262144

net.ipv4.tcp_max_syn_backlog = 262144

net.ipv4.tcp_synack_retries = 2

net.ipv4.tcp_syn_retries = 2

這個配置參考于cache服務器varnish的推薦配置和SunOne 服務器系統優化的推薦配置。

varnish調優推薦配置的地址為:http://varnish.projects.linpro.no/wiki/Performance

不過varnish推薦的配置是有問題的,實際運行表明“net.ipv4.tcp_fin_timeout = 3”的配置會導致頁面經常打不開;并且當網友使用的是IE6瀏覽器時,訪問網站一段時間后,所有網頁都會打不開,重啟瀏覽器后正常。可能是國外的網速快吧,我們國情決定需要調整“net.ipv4.tcp_fin_timeout = 10”,在10s的情況下,一切正常(實際運行結論)。

修改完畢后,執行:

/sbin/sysctl -p /etc/sysctl.conf

/sbin/sysctl -w net.ipv4.route.flush=1

命令生效。為了保險起見,也可以reboot系統。

調整文件數:

linux系統優化完網絡必須調高系統允許打開的文件數才能支持大的并發,默認1024是遠遠不夠的。

執行命令:

echo ulimit -HSn 65536 >> /etc/rc.local

echo ulimit -HSn 65536 >>/root/.bash_profile

ulimit -HSn 65536

備注:

對mysql用戶可同時打開文件數設置為10240個;

將Linux系統可同時打開文件數設置為1000000個(一定要大于對用戶的同時打開文件數限制);

將Linux系統對最大追蹤的TCP連接數限制為20000個(但是,建議設置為10240;因為對mysql用戶的同時打開文件數已經限制在10240個;且較小的值可以節省內存);

將linux系統端口范圍配置為1024~30000(可以支持60000個以上連接,不建議修改;默認已經支持20000個以上連接);

綜合上述四點,TCP連接數限制在10140個。

這10240個文件中還得除去每個進程必然打開的標準輸入,標準輸出,標準錯誤,服務器監聽 socket,進程間通訊的unix域socket等文件。

因此,當需要對TCP連接數進行調整時只需要調整ulimit參數。

Linux下查看tcp連接數及狀態命令:

netstat -n | awk '/^tcp/ {++S[$NF]} END {for(a in S) print a, S[a]}'

以上就是“linux系統影響tcp連接數的因素是什么”這篇文章的所有內容,感謝各位的閱讀!相信大家閱讀完這篇文章都有很大的收獲,小編每天都會為大家更新不同的知識,如果還想學習更多的知識,請關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。