您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹了怎么使用C++ OpenCV實現圖像拼接的相關知識,內容詳細易懂,操作簡單快捷,具有一定借鑒價值,相信大家閱讀完這篇怎么使用C++ OpenCV實現圖像拼接文章都會有所收獲,下面我們一起來看看吧。

一幅圖中總存在著一些獨特的像素點,這些點我們可以認為就是這幅圖的特征,即為特征點

獲取一幅圖中存在的一些獨特的像素點,需要解決兩個問題:

解決尺度不變性問題,不同大小的圖片獲取到的特征是一樣的

提取到的特征點要穩定,能被精確定位

| 名稱 | 支持尺寸不變性 | 速度 |

| SURF | 支持 | 快 |

| SIFT | 支持 | 比SURF慢 |

| ORB | 不支持 | SURF算法快10倍 |

| FAST | 沒有尺度不變性 | 比ORB快 |

透視變換是按照物體成像投影規律進行變換,即將物體重新投影到新的成像平面

透視變換常用于機器人視覺導航研究中,由于相機視場與地面存在傾斜角使得物體成像產生畸變,通常通過透視變換實現對物體圖像的校正

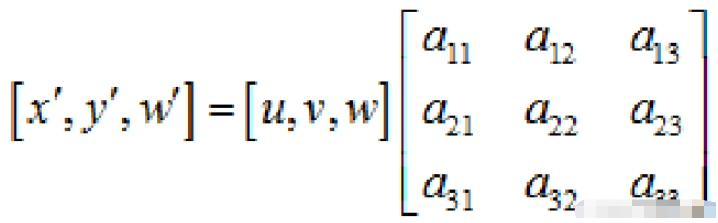

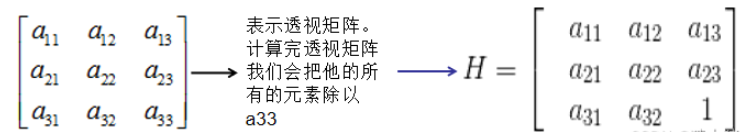

[u,v,w] 表示當前平面坐標的x,y,z,如果是平面,那么z=1

[x',y',z'] 表示目標平面坐標的x,y,z,如果是平面,那么z=1

以上公式,我們可以理解為,透視矩陣是原始平面可目標平面之間的一種轉換關系

將一副圖像拷貝到另一副圖像上的過程

設置需要處理的兩張圖片,進行拼接準備工作

Mat left=imread("C:/Users/86177/Desktop/image/a11.png");//左側:圖片路徑

Mat right=imread("C:/Users/86177/Desktop/image/a22.png");//右側:圖片路徑

imshow("left",left);

imshow("right",right);用SIFT算法來實現圖像拼接是很常用的方法,雖說SURF精確度和穩定性不及SIFT,但是其綜合能力還是優越一些

//創建SURF對象

Ptr<SURF>surf; //可以容納800個特征點

surf = SURF::create(800);//參數 查找的海森矩陣 create 海森矩陣閥值

//暴力匹配器

BFMatcher matcher;

vector<KeyPoint>key1,key2;

Mat c,d;

//尋找特征點

surf->detectAndCompute(left,Mat(),key2,d);

surf->detectAndCompute(right,Mat(),key1,c);

//特征點對比,保存下來

vector<DMatch>matches;//DMatch 點和點之間的關系

//使用暴力匹配器匹配特征點,找到存來

matcher.match(d,c,matches);

//排序 從小到大

sort(matches.begin(),matches.end());

//保留最優的特征點對象

vector<DMatch>good_matches;//最優

//設置比例

int ptrPoint = std::min(50,(int)(matches.size()*0.15));

for(int i = 0;i < ptrPoint;i++)

{

good_matches.push_back(matches[i]);

}

//最佳匹配的特征點連成線

Mat outimg;

drawMatches(left,key2,right,key1,good_matches,outimg,

Scalar::all(-1),Scalar::all(-1),

vector<char>(),DrawMatchesFlags::NOT_DRAW_SINGLE_POINTS);

imshow("outimg",outimg);我們就可以得到了兩幅待拼接圖的匹配點集,接下來我們進行圖像的配準,即將兩張圖像轉換為同一坐標下

//特征點配準

vector<Point2f>imagepoint1,imagepoint2;

for(int i = 0;i<good_matches.size();i++)

{

imagepoint1.push_back(key1[good_matches[i].trainIdx].pt);

imagepoint2.push_back(key2[good_matches[i].queryIdx].pt);

}

//透視轉換

Mat homo = findHomography(imagepoint1,imagepoint2,CV_RANSAC);

imshow("homo",homo);將我們的左圖拷貝到設置好的配準圖(右圖)上

//創建拼接后的圖,計算圖的大小

int dst_width = imageTranForm.cols;//獲取最右點為拼接圖長度

int dst_height = left.rows;

Mat dst(dst_height,dst_width,CV_8UC3);

dst.setTo(0);

imageTranForm.copyTo(dst(Rect(0,0,imageTranForm.cols,imageTranForm.rows)));

left.copyTo(dst(Rect(0,0,left.cols,left.rows)));

imshow("dst",dst);去裂縫處理,讓我們的優化兩圖的連接處,使得拼接自然

PS:上面拼接完的圖片看不太出來,拼接處理中,還是建議用上

//優化兩圖的連接處,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//開始位置,即重疊區域的左邊界

double processWidth = img1.cols - start;//重疊區域的寬度

int rows = dst.rows;

int cols = img1.cols; //注意,是列數*通道數

double alpha = 1;//img1中像素的權重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //獲取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到圖像trans中無像素的黑點,則完全拷貝img1中的數據

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的權重,與當前處理點距重疊區域左邊界的距離成正比,實驗證明,這種方法確實好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}#include <iostream>

#include <opencv2/opencv.hpp>

#include <opencv2/highgui.hpp>

#include <opencv2/xfeatures2d.hpp>

#include <opencv2/calib3d.hpp>

#include <opencv2/imgproc.hpp>

using namespace std;

using namespace cv;

using namespace cv::xfeatures2d;

typedef struct

{

//四個頂點

Point2f left_top;

Point2f left_bottom;

Point2f right_top;

Point2f right_bottom;

}four_corners_t;

four_corners_t corners;

//計算配準圖的四個頂點坐標

void CalcCorners(const Mat& H, const Mat& src)

{

double v2[] = { 0, 0, 1 };//左上角

double v1[3];//變換后的坐標值

Mat V2 = Mat(3, 1, CV_64FC1, v2); //列向量

Mat V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

//左上角(0,0,1)

cout << "V2: " << V2 << endl;

cout << "V1: " << V1 << endl;

corners.left_top.x = v1[0] / v1[2];

corners.left_top.y = v1[1] / v1[2];

//左下角(0,src.rows,1)

v2[0] = 0;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.left_bottom.x = v1[0] / v1[2];

corners.left_bottom.y = v1[1] / v1[2];

//右上角(src.cols,0,1)

v2[0] = src.cols;

v2[1] = 0;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_top.x = v1[0] / v1[2];

corners.right_top.y = v1[1] / v1[2];

//右下角(src.cols,src.rows,1)

v2[0] = src.cols;

v2[1] = src.rows;

v2[2] = 1;

V2 = Mat(3, 1, CV_64FC1, v2); //列向量

V1 = Mat(3, 1, CV_64FC1, v1); //列向量

V1 = H * V2;

corners.right_bottom.x = v1[0] / v1[2];

corners.right_bottom.y = v1[1] / v1[2];

}

//優化兩圖的連接處,使得拼接自然

void OptimizeSeam(Mat& img1, Mat& trans, Mat& dst)

{

int start = MIN(corners.left_top.x, corners.left_bottom.x);//開始位置,即重疊區域的左邊界

double processWidth = img1.cols - start;//重疊區域的寬度

int rows = dst.rows;

int cols = img1.cols; //注意,是列數*通道數

double alpha = 1;//img1中像素的權重

for (int i = 0; i < rows; i++)

{

uchar* p = img1.ptr<uchar>(i); //獲取第i行的首地址

uchar* t = trans.ptr<uchar>(i);

uchar* d = dst.ptr<uchar>(i);

for (int j = start; j < cols; j++)

{

//如果遇到圖像trans中無像素的黑點,則完全拷貝img1中的數據

if (t[j * 3] == 0 && t[j * 3 + 1] == 0 && t[j * 3 + 2] == 0)

{

alpha = 1;

}

else

{

//img1中像素的權重,與當前處理點距重疊區域左邊界的距離成正比,實驗證明,這種方法確實好

alpha = (processWidth - (j - start)) / processWidth;

}

d[j * 3] = p[j * 3] * alpha + t[j * 3] * (1 - alpha);

d[j * 3 + 1] = p[j * 3 + 1] * alpha + t[j * 3 + 1] * (1 - alpha);

d[j * 3 + 2] = p[j * 3 + 2] * alpha + t[j * 3 + 2] * (1 - alpha);

}

}

}

int main(int argc, char *argv[])

{

Mat left=imread("C:/Users/86177/Desktop/image/test(1).png");//左側:圖片路徑

Mat right=imread("C:/Users/86177/Desktop/image/test(2).png");//右側:圖片路徑

imshow("left",left);

imshow("right",right);

//創建SURF對象

Ptr<SURF>surf; //可以容納800個特征點

surf = SURF::create(800);//參數 查找的海森矩陣 create 海森矩陣閥值

//暴力匹配器

BFMatcher matcher;

vector<KeyPoint>key1,key2;

Mat c,d;

//尋找特征點

surf->detectAndCompute(left,Mat(),key2,d);

surf->detectAndCompute(right,Mat(),key1,c);

//特征點對比,保存下來

vector<DMatch>matches;//DMatch 點和點之間的關系

//使用暴力匹配器匹配特征點,找到存來

matcher.match(d,c,matches);

//排序 從小到大

sort(matches.begin(),matches.end());

//保留最優的特征點對象

vector<DMatch>good_matches;//最優

//設置比例

int ptrPoint = std::min(50,(int)(matches.size()*0.15));

for(int i = 0;i < ptrPoint;i++)

{

good_matches.push_back(matches[i]);

}

//最佳匹配的特征點連成線

Mat outimg;

drawMatches(left,key2,right,key1,good_matches,outimg,

Scalar::all(-1),Scalar::all(-1),

vector<char>(),DrawMatchesFlags::NOT_DRAW_SINGLE_POINTS);

imshow("outimg",outimg);

//特征點配準

vector<Point2f>imagepoint1,imagepoint2;

for(int i = 0;i<good_matches.size();i++)

{

imagepoint1.push_back(key1[good_matches[i].trainIdx].pt);

imagepoint2.push_back(key2[good_matches[i].queryIdx].pt);

}

//透視轉換

Mat homo = findHomography(imagepoint1,imagepoint2,CV_RANSAC);

imshow("homo",homo);

//四個頂點坐標的轉換計算

CalcCorners(homo,right);

Mat imageTranForm;

warpPerspective(right,imageTranForm,homo,

Size(MAX(corners.right_top.x,

corners.right_bottom.x),

left.rows));

imshow("imageTranForm",imageTranForm);

//創建拼接后的圖,計算圖的大小

int dst_width = imageTranForm.cols;//獲取最右點為拼接圖長度

int dst_height = left.rows;

Mat dst(dst_height,dst_width,CV_8UC3);

dst.setTo(0);

imageTranForm.copyTo(dst(Rect(0,0,imageTranForm.cols,imageTranForm.rows)));

left.copyTo(dst(Rect(0,0,left.cols,left.rows)));

//優化拼接,主要目的去除黑邊

OptimizeSeam(left,imageTranForm, dst);

imshow("dst",dst);

waitKey(0);

return 0;

}關于“怎么使用C++ OpenCV實現圖像拼接”這篇文章的內容就介紹到這里,感謝各位的閱讀!相信大家對“怎么使用C++ OpenCV實現圖像拼接”知識都有一定的了解,大家如果還想學習更多知識,歡迎關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。