您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇“如何快速上手python爬蟲”文章的知識點大部分人都不太理解,所以小編給大家總結了以下內容,內容詳細,步驟清晰,具有一定的借鑒價值,希望大家閱讀完這篇文章能有所收獲,下面我們一起來看看這篇“如何快速上手python爬蟲”文章吧。

“爬蟲”是一種形象的說法。互聯網比喻成一張大網,爬蟲是一個程序或腳本在這種大網上爬走。碰到蟲子(資源),若是所需的資源就獲取或下載下來。這個資源通常是網頁、文件等等,可以通過該資源里面的url鏈接,順藤摸瓜繼續爬取這些鏈接的資源。

爬蟲:一段自動抓取互聯網信息的程序,從互聯網上抓取對于我們有價值的信息。

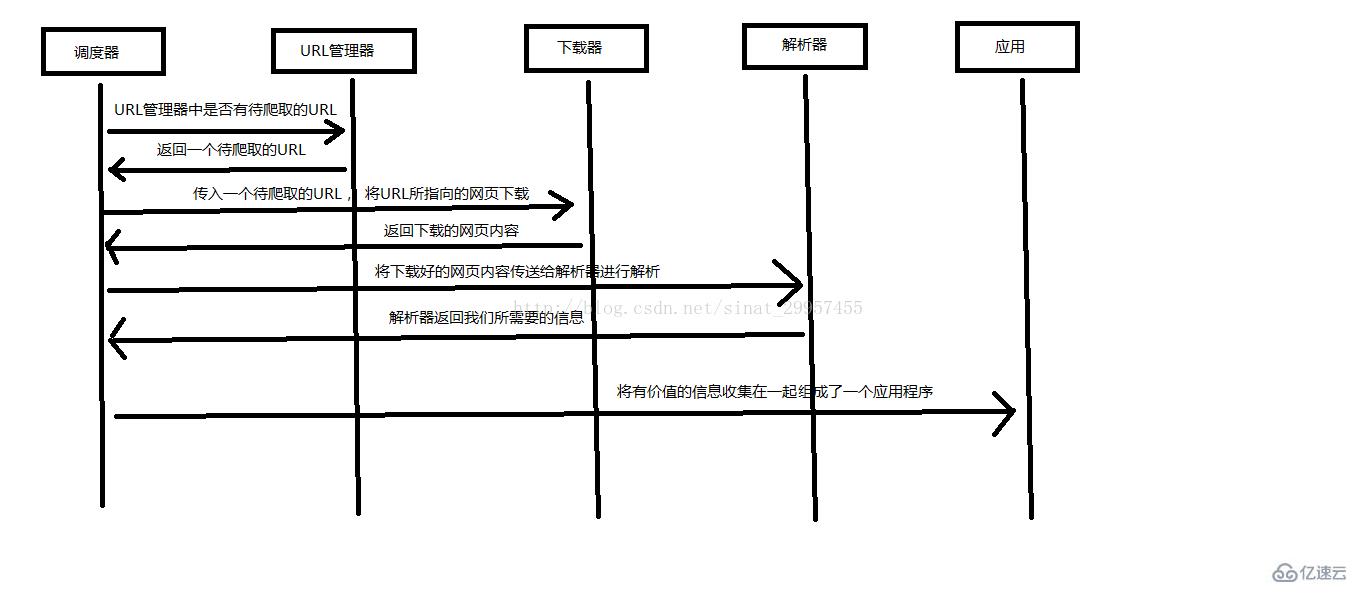

Python 爬蟲架構主要由五個部分組成,分別是調度器、URL管理器、網頁下載器、網頁解析器、應用程序(爬取的有價值數據)。

下面用一個圖來解釋一下調度器是如何協調工作的:

#!/usr/bin/python# -*- coding: UTF-8 -*-import cookielib

import urllib2

url = "http://www.baidu.com"response1 = urllib2.urlopen(url)print "第一種方法"#獲取狀態碼,200表示成功print response1.getcode()#獲取網頁內容的長度print len(response1.read())print "第二種方法"request = urllib2.Request(url)#模擬Mozilla瀏覽器進行爬蟲request.add_header("user-agent","Mozilla/5.0")

response2 = urllib2.urlopen(request)print response2.getcode()print len(response2.read())print "第三種方法"cookie = cookielib.CookieJar()#加入urllib2處理cookie的能力opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cookie))

urllib2.install_opener(opener)

response3 = urllib2.urlopen(url)print response3.getcode()print len(response3.read())print cookie第三方庫 Beautiful Soup 的安裝

Beautiful Soup: Python 的第三方插件用來提取 xml 和 HTML 中的數據,官網地址 https://www.crummy.com/software/BeautifulSoup/

打開 cmd(命令提示符),進入到 Python(Python2.7版本)安裝目錄中的 scripts 下,輸入 dir 查看是否有 pip.exe, 如果用就可以使用 Python 自帶的 pip 命令進行安裝,輸入以下命令進行安裝即可:

pip install beautifulsoup4

編寫一個 Python 文件,輸入:

\#!/usr/bin/python # -*- coding: UTF-8 -*- import re from bs4 import BeautifulSoup html_doc = """ The Dormouse's story **The Dormouse's story** Once upon a time there were three little sisters; and their names were [Elsie](http://example.com/elsie), [Lacie](http://example.com/lacie) and [Tillie](http://example.com/tillie); and they lived at the bottom of a well. ... """ #創建一個BeautifulSoup解析對象 soup = BeautifulSoup(html_doc,"html.parser",from_encoding="utf-8") #獲取所有的鏈接 links = soup.find_all('a') print "所有的鏈接" for link in links: print link.name,link['href'],link.get_text() print "獲取特定的URL地址" link_node = soup.find('a',href="http://example.com/elsie") print link_node.name,link_node['href'],link_node['class'],link_node.get_text() print "正則表達式匹配" link_node = soup.find('a',href=re.compile(r"ti")) print link_node.name,link_node['href'],link_node['class'],link_node.get_text() print "獲取P段落的文字" p_node = soup.find('p',class_='story') print p_node.name,p_node['class'],p_node.get_text()以上就是關于“如何快速上手python爬蟲”這篇文章的內容,相信大家都有了一定的了解,希望小編分享的內容對大家有幫助,若想了解更多相關的知識內容,請關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。