您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹了如何構建Apache Flink應用,具有一定借鑒價值,感興趣的朋友可以參考下,希望大家閱讀完這篇文章之后大有收獲,下面讓小編帶著大家一起了解一下。

Flink 可以運行在 Linux, Max OS X, 或者是 Windows 上。為了開發 Flink 應用程序,在本地機器上需要有 Java 8.x 和 maven 環境。

如果有 Java 8 環境,運行下面的命令會輸出如下版本信息:

$ java -version java version "1.8.0_65" Java(TM) SE Runtime Environment (build 1.8.0_65-b17) Java HotSpot(TM) 64-Bit Server VM (build 25.65-b01, mixed mode)

如果有 maven 環境,運行下面的命令會輸出如下版本信息:

$ mvn -version Apache Maven 3.5.4 (1edded0938998edf8bf061f1ceb3cfdeccf443fe; 2018-06-18T02:33:14+08:00) Maven home: /Users/wuchong/dev/maven Java version: 1.8.0_65, vendor: Oracle Corporation, runtime: /Library/Java/JavaVirtualMachines/jdk1.8.0_65.jdk/Contents/Home/jre Default locale: zh_CN, platform encoding: UTF-8 OS name: "mac os x", version: "10.13.6", arch: "x86_64", family: "mac"

另外我們推薦使用 ItelliJ IDEA (社區免費版已夠用)作為 Flink 應用程序的開發 IDE。Eclipse 雖然也可以,但是 Eclipse 在 Scala 和 Java 混合型項目下會有些已知問題,所以不太推薦 Eclipse。下一章節,我們會介紹如何創建一個 Flink 工程并將其導入 ItelliJ IDEA。

啟動 IntelliJ IDEA,選擇 “Import Project”(導入項目),選擇 my-flink-project 根目錄下的 pom.xml。根據引導,完成項目導入。

在 src/main/java/myflink 下創建 SocketWindowWordCount.java 文件:

package myflink;

public class SocketWindowWordCount {

public static void main(String[] args) throws Exception {

}

}現在這程序還很基礎,我們會一步步往里面填代碼。注意下文中我們不會將 import 語句也寫出來,因為 IDE 會自動將他們添加上去。在本節末尾,我會將完整的代碼展示出來,如果你想跳過下面的步驟,可以直接將最后的完整代碼粘到編輯器中。

Flink 程序的第一步是創建一個 StreamExecutionEnvironment 。這是一個入口類,可以用來設置參數和創建數據源以及提交任務。所以讓我們把它添加到 main 函數中:

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

下一步我們將創建一個從本地端口號 9000 的 socket 中讀取數據的數據源:

DataStream text = env.socketTextStream("localhost", 9000, "\n");這創建了一個字符串類型的 DataStream。DataStream 是 Flink 中做流處理的核心 API,上面定義了非常多常見的操作(如,過濾、轉換、聚合、窗口、關聯等)。在本示例中,我們感興趣的是每個單詞在特定時間窗口中出現的次數,比如說5秒窗口。為此,我們首先要將字符串數據解析成單詞和次數(使用Tuple2<String, Integer>表示),第一個字段是單詞,第二個字段是次數,次數初始值都設置成了1。我們實現了一個 flatmap 來做解析的工作,因為一行數據中可能有多個單詞。

DataStream> wordCounts = text

.flatMap(new FlatMapFunction>() {

@Override

public void flatMap(String value, Collector> out) {

for (String word : value.split("\\s")) {

out.collect(Tuple2.of(word, 1));

}

}

});接著我們將數據流按照單詞字段(即0號索引字段)做分組,這里可以簡單地使用 keyBy(int index) 方法,得到一個以單詞為 key 的Tuple2<String, Integer>數據流。然后我們可以在流上指定想要的窗口,并根據窗口中的數據計算結果。在我們的例子中,我們想要每5秒聚合一次單詞數,每個窗口都是從零開始統計的:

DataStream> windowCounts = wordCounts .keyBy(0) .timeWindow(Time.seconds(5)) .sum(1);

第二個調用的 .timeWindow() 指定我們想要5秒的翻滾窗口(Tumble)。第三個調用為每個key每個窗口指定了sum聚合函數,在我們的例子中是按照次數字段(即1號索引字段)相加。得到的結果數據流,將每5秒輸出一次這5秒內每個單詞出現的次數。

最后一件事就是將數據流打印到控制臺,并開始執行:

windowCounts.print().setParallelism(1);

env.execute("Socket Window WordCount");最后的 env.execute 調用是啟動實際Flink作業所必需的。所有算子操作(例如創建源、聚合、打印)只是構建了內部算子操作的圖形。只有在execute()被調用時才會在提交到集群上或本地計算機上執行。

下面是完整的代碼,部分代碼經過簡化(代碼在 GitHub 上也能訪問到):

package myflink;

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.api.java.tuple.Tuple2;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

import org.apache.flink.streaming.api.windowing.time.Time;

import org.apache.flink.util.Collector;

public class SocketWindowWordCount {

public static void main(String[] args) throws Exception {

// 創建 execution environment

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 通過連接 socket 獲取輸入數據,這里連接到本地9876端口,如果9876端口已被占用,請換一個端口

DataStream<String> text = env.socketTextStream("localhost", 9876, "\n");

// 解析數據,按 word 分組,開窗,聚合

DataStream<Tuple2<String, Integer>> windowCounts = text

.flatMap(new FlatMapFunction<String, Tuple2<String, Integer>>() {

@Override

public void flatMap(String value, Collector<Tuple2<String, Integer>> out) {

for (String word : value.split("\\s")) {

out.collect(Tuple2.of(word, 1));

}

}

})

.keyBy(0)

.timeWindow(Time.seconds(5))

.sum(1);

// 將結果打印到控制臺,注意這里使用的是單線程打印,而非多線程

windowCounts.print().setParallelism(1);

env.execute("Socket Window WordCount");

}

}要運行示例程序,首先我們在終端啟動 netcat 獲得輸入流:

nc -lk 9000

如果是 Windows 平臺,可以通過 https://nmap.org/ncat/ 安裝 ncat 然后運行:

ncat -lk 9000

然后直接運行SocketWindowWordCount的 main 方法。

只需要在 netcat 控制臺輸入單詞,就能在 SocketWindowWordCount 的輸出控制臺看到每個單詞的詞頻統計。如果想看到大于1的計數,請在5秒內反復鍵入相同的單詞。

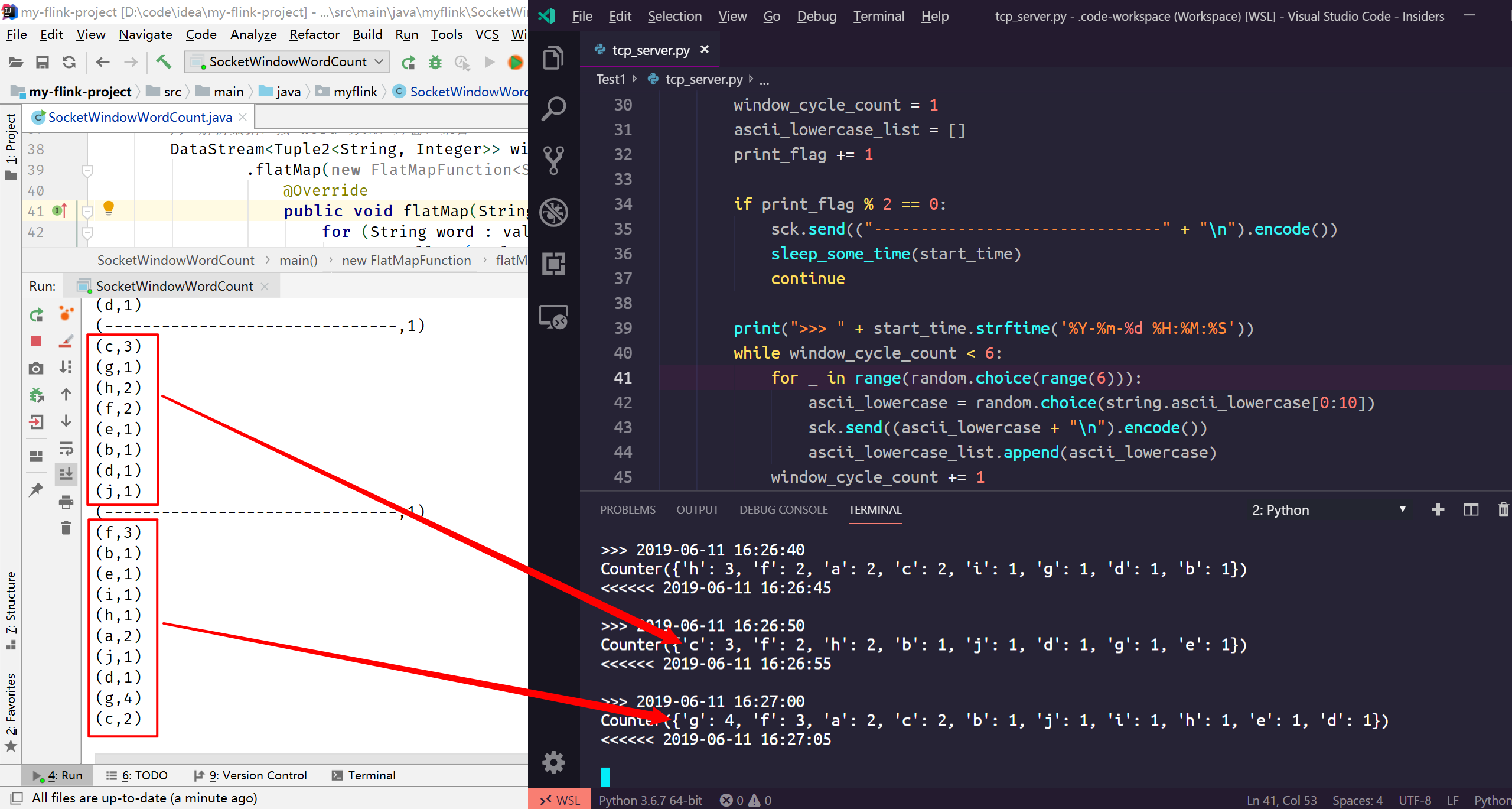

我這里寫了個簡單的 tcp_server.py 模擬上述手動 nc 操作,大家可以持續觀察 flink 窗口統計結果正確性:

import socket

import string

import random

import time

import datetime

import os

from collections import Counter

tcpServerSocket = socket.socket()

host, port = "localhost", 9876 # host = socket.gethostname()#獲取本地主機名

tcpServerSocket.bind((host, port))

tcpServerSocket.listen(2) # 代辦事件中排隊等待connect的最大數目

def sleep_some_time(start_time):

end_time = datetime.datetime.now()

rest_time = 5 - (end_time-start_time).seconds

sleep_time = rest_time if 0 <= rest_time <= 5 else 0

time.sleep(sleep_time)

while True:

#sck是該connection上可以發送和接收數據的新套接字對象, addr是與connection另一端的套接字綁定的地址

sck, addr = tcpServerSocket.accept()

print('客戶端連接地址:', addr)

print_flag = 0

while 1:

start_time = datetime.datetime.now()

window_cycle_count = 1

ascii_lowercase_list = []

print_flag += 1

if print_flag % 2 == 0:

sck.send(("-------------------------------" + "\n").encode())

sleep_some_time(start_time)

continue

print(">>> " + start_time.strftime('%Y-%m-%d %H:%M:%S'))

while window_cycle_count < 6:

for _ in range(random.choice(range(6))):

ascii_lowercase = random.choice(string.ascii_lowercase[0:10])

sck.send((ascii_lowercase + "\n").encode())

ascii_lowercase_list.append(ascii_lowercase)

window_cycle_count += 1

print(Counter(ascii_lowercase_list))

sleep_some_time(start_time)

print("<<<<<< " + datetime.datetime.now().strftime('%Y-%m-%d %H:%M:%S') + "\n")

感謝你能夠認真閱讀完這篇文章,希望小編分享的“如何構建Apache Flink應用”這篇文章對大家有幫助,同時也希望大家多多支持億速云,關注億速云行業資訊頻道,更多相關知識等著你來學習!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。