您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要講解了“spark作業調優的方法是什么”,文中的講解內容簡單清晰,易于學習與理解,下面請大家跟著小編的思路慢慢深入,一起來研究和學習“spark作業調優的方法是什么”吧!

調優概述

有的時候,我們可能會遇到大數據計算中一個最棘手的問題——數據傾斜,此時Spark作業的性能會比期望差很多。數據傾斜調優,就是使用各種技術方案解決不同類型的數據傾斜問題,以保證Spark作業的性能。

數據傾斜是多么痛?!!!

如果數據傾斜沒有解決,完全沒有可能進行性能調優,其他所有的調優手段都是一個笑話。數據傾斜是最能體現一個spark大數據工程師水平的性能調優問題。

數據傾斜如果能夠解決的話,代表對spark運行機制了如指掌。

數據傾斜倆大直接致命后果。

數據傾斜直接會導致一種情況:OOM。

運行速度慢,特別慢,非常慢,極端的慢,不可接受的慢。

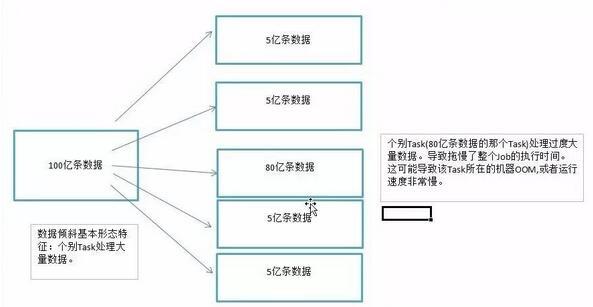

我們以100億條數據為列子。

個別Task(80億條數據的那個Task)處理過度大量數據。導致拖慢了整個Job的執行時間。這可能導致該Task所在的機器OOM,或者運行速度非常慢。

數據傾斜的原因:

在Shuffle階段。同樣Key的數據條數太多了。導致了某個key(上圖中的80億條)所在的Task數據量太大了。遠遠超過其他Task所處理的數據量。

而這樣的場景太常見了。二八定律可以證實這種場景。

搞定數據傾斜需要:

搞定shuffle

搞定業務場景

搞定 cpu core的使用情況

搞定OOM的根本原因等。

所以搞定了數據傾斜需要對至少以上的原理了如指掌。所以搞定數據傾斜是關鍵中的關鍵。

告訴大家一個屢試不爽的經驗結論:一般情況下,OOM的原因都是數據傾斜。某個task任務數據量太大,GC的壓力就很大。這比不了Kafka,因為kafka的內存是不經過JVM的。是基于Linux內核的Page。

數據傾斜發生的原理

數據傾斜的原理很簡單:在進行shuffle的時候,必須將各個節點上相同的key拉取到某個節點上的一個task來進行處理,比如按照key進行聚合或join等操作。此時如果某個key對應的數據量特別大的話,就會發生數據傾斜。比如大部分key對應10條數據,但是個別key卻對應了100萬條數據,那么大部分task可能就只會分配到10條數據,然后1秒鐘就運行完了;但是個別task可能分配到了100萬數據,要運行一兩個小時。因此,整個Spark作業的運行進度是由運行時間最長的那個task決定的。

因此出現數據傾斜的時候,Spark作業看起來會運行得非常緩慢,甚至可能因為某個task處理的數據量過大導致內存溢出。

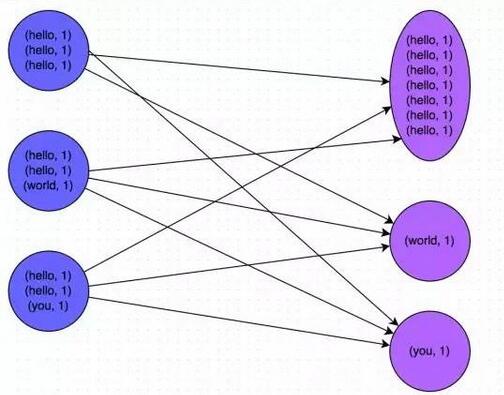

下圖就是一個很清晰的例子:hello這個key,在三個節點上對應了總共7條數據,這些數據都會被拉取到同一個task中進行處理;而world和you這兩個key分別才對應1條數據,所以另外兩個task只要分別處理1條數據即可。此時***個task的運行時間可能是另外兩個task的7倍,而整個stage的運行速度也由運行最慢的那個task所決定。

如何定位導致數據傾斜的代碼

數據傾斜只會發生在shuffle過程中。這里給大家羅列一些常用的并且可能會觸發shuffle操作的算子:distinct、groupByKey、reduceByKey、aggregateByKey、join、cogroup、repartition等。出現數據傾斜時,可能就是你的代碼中使用了這些算子中的某一個所導致的。

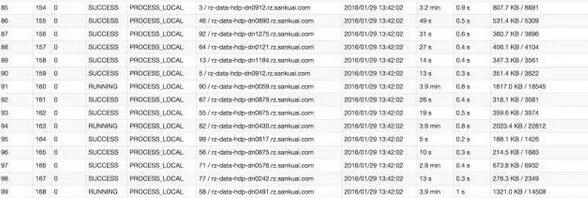

某個task執行特別慢的情況

首先要看的,就是數據傾斜發生在第幾個stage中。

如果是用yarn-client模式提交,那么本地是直接可以看到log的,可以在log中找到當前運行到了第幾個stage;如果是用yarn-cluster模式提交,則可以通過Spark Web UI來查看當前運行到了第幾個stage。此外,無論是使用yarn-client模式還是yarn-cluster模式,我們都可以在Spark Web UI上深入看一下當前這個stage各個task分配的數據量,從而進一步確定是不是task分配的數據不均勻導致了數據傾斜。

比如下圖中,倒數第三列顯示了每個task的運行時間。明顯可以看到,有的task運行特別快,只需要幾秒鐘就可以運行完;而有的task運行特別慢,需要幾分鐘才能運行完,此時單從運行時間上看就已經能夠確定發生數據傾斜了。此外,倒數***列顯示了每個task處理的數據量,明顯可以看到,運行時間特別短的task只需要處理幾百KB的數據即可,而運行時間特別長的task需要處理幾千KB的數據,處理的數據量差了10倍。此時更加能夠確定是發生了數據傾斜。

知道數據傾斜發生在哪一個stage之后,接著我們就需要根據stage劃分原理,推算出來發生傾斜的那個stage對應代碼中的哪一部分,這部分代碼中肯定會有一個shuffle類算子。精準推算stage與代碼的對應關系,需要對Spark的源碼有深入的理解,這里我們可以介紹一個相對簡單實用的推算方法:只要看到Spark代碼中出現了一個shuffle類算子或者是Spark SQL的SQL語句中出現了會導致shuffle的語句(比如group by語句),那么就可以判定,以那個地方為界限劃分出了前后兩個stage。

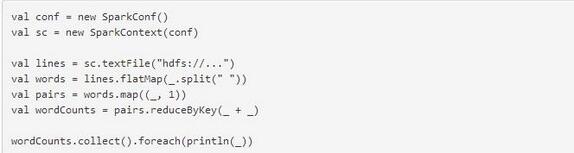

這里我們就以Spark最基礎的入門程序——單詞計數來舉例,如何用最簡單的方法大致推算出一個stage對應的代碼。如下示例,在整個代碼中,只有一個reduceByKey是會發生shuffle的算子,因此就可以認為,以這個算子為界限,會劃分出前后兩個stage。

1、stage0,主要是執行從textFile到map操作,以及執行shuffle write操作。shuffle write操作,我們可以簡單理解為對pairs RDD中的數據進行分區操作,每個task處理的數據中,相同的key會寫入同一個磁盤文件內。

2、stage1,主要是執行從reduceByKey到collect操作,stage1的各個task一開始運行,就會首先執行shuffle read操作。執行shuffle read操作的task,會從stage0的各個task所在節點拉取屬于自己處理的那些key,然后對同一個key進行全局性的聚合或join等操作,在這里就是對key的value值進行累加。stage1在執行完reduceByKey算子之后,就計算出了最終的wordCounts RDD,然后會執行collect算子,將所有數據拉取到Driver上,供我們遍歷和打印輸出。

通過對單詞計數程序的分析,希望能夠讓大家了解最基本的stage劃分的原理,以及stage劃分后shuffle操作是如何在兩個stage的邊界處執行的。然后我們就知道如何快速定位出發生數據傾斜的stage對應代碼的哪一個部分了。比如我們在Spark Web UI或者本地log中發現,stage1的某幾個task執行得特別慢,判定stage1出現了數據傾斜,那么就可以回到代碼中定位出stage1主要包括了reduceByKey這個shuffle類算子,此時基本就可以確定是由educeByKey算子導致的數據傾斜問題。比如某個單詞出現了100萬次,其他單詞才出現10次,那么stage1的某個task就要處理100萬數據,整個stage的速度就會被這個task拖慢。

數據傾斜的解決方案

解決方案一:使用Hive ETL預處理數據

方案適用場景:導致數據傾斜的是Hive表。如果該Hive表中的數據本身很不均勻(比如某個key對應了100萬數據,其他key才對應了10條數據),而且業務場景需要頻繁使用Spark對Hive表執行某個分析操作,那么比較適合使用這種技術方案。

方案實現思路:此時可以評估一下,是否可以通過Hive來進行數據預處理(即通過Hive ETL預先對數據按照key進行聚合,或者是預先和其他表進行join),然后在Spark作業中針對的數據源就不是原來的Hive表了,而是預處理后的Hive表。此時由于數據已經預先進行過聚合或join操作了,那么在Spark作業中也就不需要使用原先的shuffle類算子執行這類操作了。

方案實現原理:這種方案從根源上解決了數據傾斜,因為徹底避免了在Spark中執行shuffle類算子,那么肯定就不會有數據傾斜的問題了。但是這里也要提醒一下大家,這種方式屬于治標不治本。因為畢竟數據本身就存在分布不均勻的問題,所以Hive ETL中進行group by或者join等shuffle操作時,還是會出現數據傾斜,導致Hive ETL的速度很慢。我們只是把數據傾斜的發生提前到了Hive ETL中,避免Spark程序發生數據傾斜而已。

方案優點:實現起來簡單便捷,效果還非常好,完全規避掉了數據傾斜,Spark作業的性能會大幅度提升。

方案缺點:治標不治本,Hive ETL中還是會發生數據傾斜。

方案實踐經驗:在一些Java系統與Spark結合使用的項目中,會出現Java代碼頻繁調用Spark作業的場景,而且對Spark作業的執行性能要求很高,就比較適合使用這種方案。將數據傾斜提前到上游的Hive ETL,每天僅執行一次,只有那一次是比較慢的,而之后每次Java調用Spark作業時,執行速度都會很快,能夠提供更好的用戶體驗。

項目實踐經驗:在美團·點評的交互式用戶行為分析系統中使用了這種方案,該系統主要是允許用戶通過Java Web系統提交數據分析統計任務,后端通過Java提交Spark作業進行數據分析統計。要求Spark作業速度必須要快,盡量在10分鐘以內,否則速度太慢,用戶體驗會很差。所以我們將有些Spark作業的shuffle操作提前到了Hive ETL中,從而讓Spark直接使用預處理的Hive中間表,盡可能地減少Spark的shuffle操作,大幅度提升了性能,將部分作業的性能提升了6倍以上。

解決方案二:過濾少數導致傾斜的key

方案適用場景:如果發現導致傾斜的key就少數幾個,而且對計算本身的影響并不大的話,那么很適合使用這種方案。比如99%的key就對應10條數據,但是只有一個key對應了100萬數據,從而導致了數據傾斜。

方案實現思路:如果我們判斷那少數幾個數據量特別多的key,對作業的執行和計算結果不是特別重要的話,那么干脆就直接過濾掉那少數幾個key。比如,在Spark SQL中可以使用where子句過濾掉這些key或者在Spark Core中對RDD執行filter算子過濾掉這些key。如果需要每次作業執行時,動態判定哪些key的數據量最多然后再進行過濾,那么可以使用sample算子對RDD進行采樣,然后計算出每個key的數量,取數據量最多的key過濾掉即可。

方案實現原理:將導致數據傾斜的key給過濾掉之后,這些key就不會參與計算了,自然不可能產生數據傾斜。

方案優點:實現簡單,而且效果也很好,可以完全規避掉數據傾斜。

方案缺點:適用場景不多,大多數情況下,導致傾斜的key還是很多的,并不是只有少數幾個。

方案實踐經驗:在項目中我們也采用過這種方案解決數據傾斜。有一次發現某一天Spark作業在運行的時候突然OOM了,追查之后發現,是Hive表中的某一個key在那天數據異常,導致數據量暴增。因此就采取每次執行前先進行采樣,計算出樣本中數據量***的幾個key之后,直接在程序中將那些key給過濾掉。

解決方案三:提高shuffle操作的并行度

方案適用場景:如果我們必須要對數據傾斜迎難而上,那么建議優先使用這種方案,因為這是處理數據傾斜最簡單的一種方案。

方案實現思路:在對RDD執行shuffle算子時,給shuffle算子傳入一個參數,比如reduceByKey(1000),該參數就設置了這個shuffle算子執行時shuffle read task的數量。對于Spark SQL中的shuffle類語句,比如group by、join等,需要設置一個參數,即spark.sql.shuffle.partitions,該參數代表了shuffle read task的并行度,該值默認是200,對于很多場景來說都有點過小。

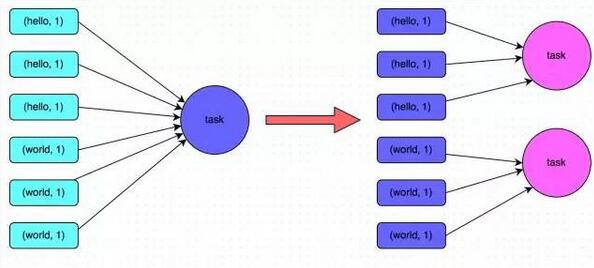

方案實現原理:增加shuffle read task的數量,可以讓原本分配給一個task的多個key分配給多個task,從而讓每個task處理比原來更少的數據。舉例來說,如果原本有5個key,每個key對應10條數據,這5個key都是分配給一個task的,那么這個task就要處理50條數據。而增加了shuffle read task以后,每個task就分配到一個key,即每個task就處理10條數據,那么自然每個task的執行時間都會變短了。具體原理如下圖所示。

方案優點:實現起來比較簡單,可以有效緩解和減輕數據傾斜的影響。

方案缺點:只是緩解了數據傾斜而已,沒有徹底根除問題,根據實踐經驗來看,其效果有限。

方案實踐經驗:該方案通常無法徹底解決數據傾斜,因為如果出現一些極端情況,比如某個key對應的數據量有100萬,那么無論你的task數量增加到多少,這個對應著100萬數據的key肯定還是會分配到一個task中去處理,因此注定還是會發生數據傾斜的。所以這種方案只能說是在發現數據傾斜時嘗試使用的***種手段,嘗試去用嘴簡單的方法緩解數據傾斜而已,或者是和其他方案結合起來使用。

解決方案四:兩階段聚合(局部聚合+全局聚合)

方案適用場景:對RDD執行reduceByKey等聚合類shuffle算子或者在Spark SQL中使用group by語句進行分組聚合時,比較適用這種方案。

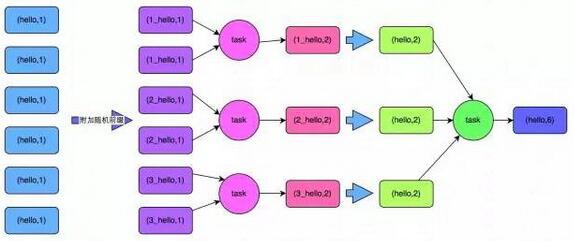

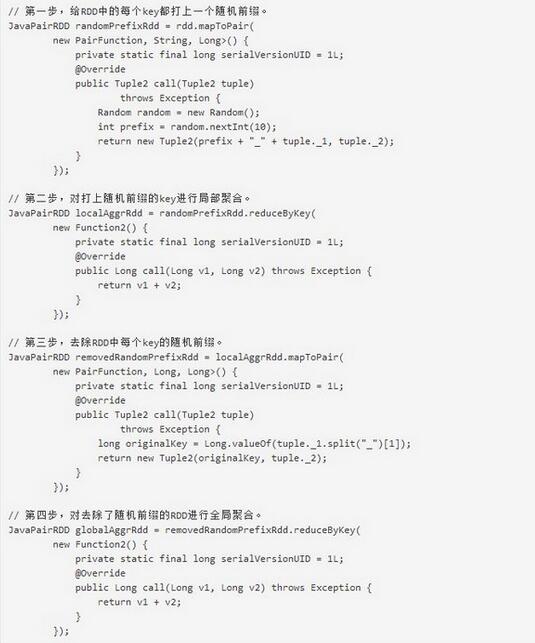

方案實現思路:這個方案的核心實現思路就是進行兩階段聚合。***次是局部聚合,先給每個key都打上一個隨機數,比如10以內的隨機數,此時原先一樣的key就變成不一樣的了,比如(hello, 1) (hello, 1) (hello, 1) (hello, 1),就會變成(1_hello, 1) (1_hello, 1) (2_hello, 1) (2_hello, 1)。接著對打上隨機數后的數據,執行reduceByKey等聚合操作,進行局部聚合,那么局部聚合結果,就會變成了(1_hello, 2) (2_hello, 2)。然后將各個key的前綴給去掉,就會變成(hello,2)(hello,2),再次進行全局聚合操作,就可以得到最終結果了,比如(hello, 4)。

方案實現原理:將原本相同的key通過附加隨機前綴的方式,變成多個不同的key,就可以讓原本被一個task處理的數據分散到多個task上去做局部聚合,進而解決單個task處理數據量過多的問題。接著去除掉隨機前綴,再次進行全局聚合,就可以得到最終的結果。具體原理見下圖。

方案優點:對于聚合類的shuffle操作導致的數據傾斜,效果是非常不錯的。通常都可以解決掉數據傾斜,或者至少是大幅度緩解數據傾斜,將Spark作業的性能提升數倍以上。

方案缺點:僅僅適用于聚合類的shuffle操作,適用范圍相對較窄。如果是join類的shuffle操作,還得用其他的解決方案。

解決方案五:將reduce join轉為map join

方案適用場景:在對RDD使用join類操作,或者是在Spark SQL中使用join語句時,而且join操作中的一個RDD或表的數據量比較小(比如幾百M或者一兩G),比較適用此方案。

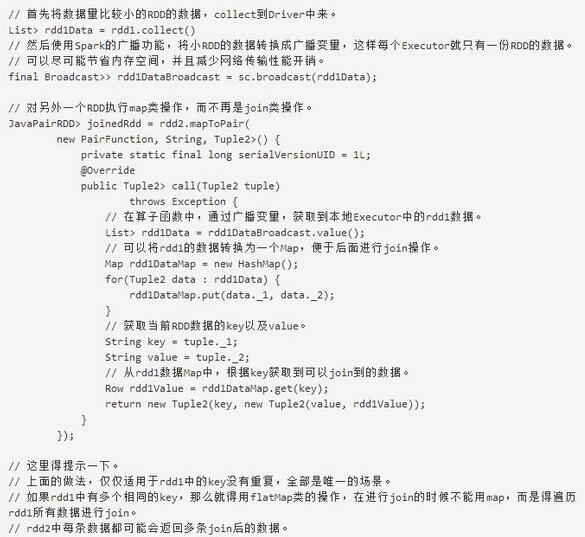

方案實現思路:不使用join算子進行連接操作,而使用Broadcast變量與map類算子實現join操作,進而完全規避掉shuffle類的操作,徹底避免數據傾斜的發生和出現。將較小RDD中的數據直接通過collect算子拉取到Driver端的內存中來,然后對其創建一個Broadcast變量;接著對另外一個RDD執行map類算子,在算子函數內,從Broadcast變量中獲取較小RDD的全量數據,與當前RDD的每一條數據按照連接key進行比對,如果連接key相同的話,那么就將兩個RDD的數據用你需要的方式連接起來。

方案實現原理:普通的join是會走shuffle過程的,而一旦shuffle,就相當于會將相同key的數據拉取到一個shuffle read task中再進行join,此時就是reduce join。但是如果一個RDD是比較小的,則可以采用廣播小RDD全量數據+map算子來實現與join同樣的效果,也就是map join,此時就不會發生shuffle操作,也就不會發生數據傾斜。具體原理如下圖所示。

方案優點:對join操作導致的數據傾斜,效果非常好,因為根本就不會發生shuffle,也就根本不會發生數據傾斜。

方案缺點:適用場景較少,因為這個方案只適用于一個大表和一個小表的情況。畢竟我們需要將小表進行廣播,此時會比較消耗內存資源,driver和每個Executor內存中都會駐留一份小RDD的全量數據。如果我們廣播出去的RDD數據比較大,比如10G以上,那么就可能發生內存溢出了。因此并不適合兩個都是大表的情況。

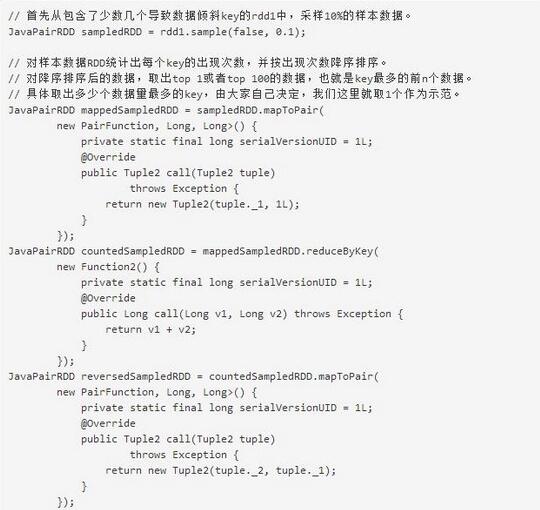

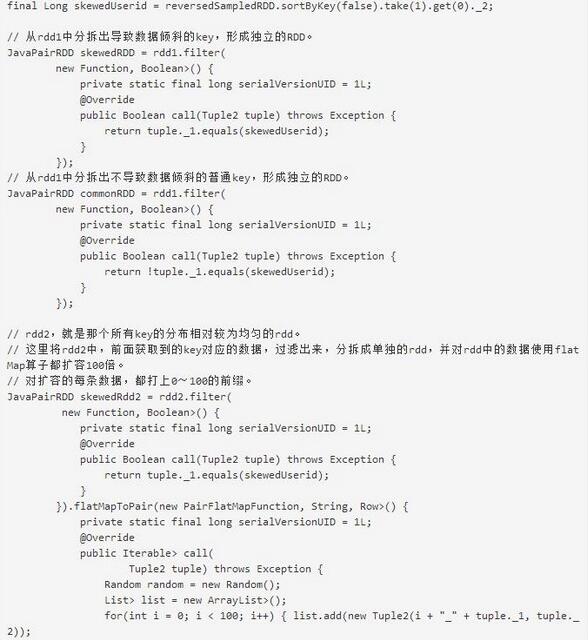

解決方案六:采樣傾斜key并分拆join操作

方案適用場景:兩個RDD/Hive表進行join的時候,如果數據量都比較大,無法采用“解決方案五”,那么此時可以看一下兩個RDD/Hive表中的key分布情況。如果出現數據傾斜,是因為其中某一個RDD/Hive表中的少數幾個key的數據量過大,而另一個RDD/Hive表中的所有key都分布比較均勻,那么采用這個解決方案是比較合適的。

方案實現思路:

對包含少數幾個數據量過大的key的那個RDD,通過sample算子采樣出一份樣本來,然后統計一下每個key的數量,計算出來數據量***的是哪幾個key。

然后將這幾個key對應的數據從原來的RDD中拆分出來,形成一個單獨的RDD,并給每個key都打上n以內的隨機數作為前綴,而不會導致傾斜的大部分key形成另外一個RDD。

接著將需要join的另一個RDD,也過濾出來那幾個傾斜key對應的數據并形成一個單獨的RDD,將每條數據膨脹成n條數據,這n條數據都按順序附加一個0~n的前綴,不會導致傾斜的大部分key也形成另外一個RDD。

再將附加了隨機前綴的獨立RDD與另一個膨脹n倍的獨立RDD進行join,此時就可以將原先相同的key打散成n份,分散到多個task中去進行join了。

而另外兩個普通的RDD就照常join即可。

***將兩次join的結果使用union算子合并起來即可,就是最終的join結果。

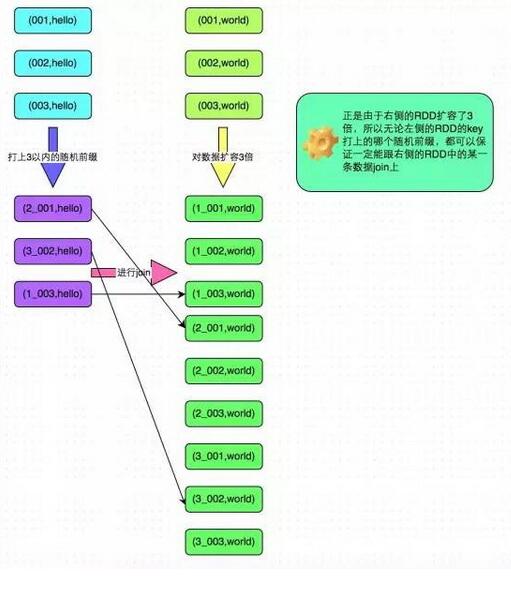

方案實現原理:對于join導致的數據傾斜,如果只是某幾個key導致了傾斜,可以將少數幾個key分拆成獨立RDD,并附加隨機前綴打散成n份去進行join,此時這幾個key對應的數據就不會集中在少數幾個task上,而是分散到多個task進行join了。具體原理見下圖。

方案優點:對于join導致的數據傾斜,如果只是某幾個key導致了傾斜,采用該方式可以用最有效的方式打散key進行join。而且只需要針對少數傾斜key對應的數據進行擴容n倍,不需要對全量數據進行擴容。避免了占用過多內存。

方案缺點:如果導致傾斜的key特別多的話,比如成千上萬個key都導致數據傾斜,那么這種方式也不適合。

解決方案七:使用隨機前綴和擴容RDD進行join

方案適用場景:如果在進行join操作時,RDD中有大量的key導致數據傾斜,那么進行分拆key也沒什么意義,此時就只能使用***一種方案來解決問題了。

方案實現思路:

該方案的實現思路基本和“解決方案六”類似,首先查看RDD/Hive表中的數據分布情況,找到那個造成數據傾斜的RDD/Hive表,比如有多個key都對應了超過1萬條數據。

然后將該RDD的每條數據都打上一個n以內的隨機前綴。

同時對另外一個正常的RDD進行擴容,將每條數據都擴容成n條數據,擴容出來的每條數據都依次打上一個0~n的前綴。

***將兩個處理后的RDD進行join即可。

方案實現原理:將原先一樣的key通過附加隨機前綴變成不一樣的key,然后就可以將這些處理后的“不同key”分散到多個task中去處理,而不是讓一個task處理大量的相同key。該方案與“解決方案六”的不同之處就在于,上一種方案是盡量只對少數傾斜key對應的數據進行特殊處理,由于處理過程需要擴容RDD,因此上一種方案擴容RDD后對內存的占用并不大;而這一種方案是針對有大量傾斜key的情況,沒法將部分key拆分出來進行單獨處理,因此只能對整個RDD進行數據擴容,對內存資源要求很高。

方案優點:對join類型的數據傾斜基本都可以處理,而且效果也相對比較顯著,性能提升效果非常不錯。

方案缺點:該方案更多的是緩解數據傾斜,而不是徹底避免數據傾斜。而且需要對整個RDD進行擴容,對內存資源要求很高。

方案實踐經驗:曾經開發一個數據需求的時候,發現一個join導致了數據傾斜。優化之前,作業的執行時間大約是60分鐘左右;使用該方案優化之后,執行時間縮短到10分鐘左右,性能提升了6倍。

解決方案八:多種方案組合使用

在實踐中發現,很多情況下,如果只是處理較為簡單的數據傾斜場景,那么使用上述方案中的某一種基本就可以解決。但是如果要處理一個較為復雜的數據傾斜場景,那么可能需要將多種方案組合起來使用。比如說,我們針對出現了多個數據傾斜環節的Spark作業,可以先運用解決方案一和二,預處理一部分數據,并過濾一部分數據來緩解;其次可以對某些shuffle操作提升并行度,優化其性能;***還可以針對不同的聚合或join操作,選擇一種方案來優化其性能。大家需要對這些方案的思路和原理都透徹理解之后,在實踐中根據各種不同的情況,靈活運用多種方案,來解決自己的數據傾斜問題。

感謝各位的閱讀,以上就是“spark作業調優的方法是什么”的內容了,經過本文的學習后,相信大家對spark作業調優的方法是什么這一問題有了更深刻的體會,具體使用情況還需要大家實踐驗證。這里是億速云,小編將為大家推送更多相關知識點的文章,歡迎關注!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。