您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

小編給大家分享一下CentOS 7如何安裝Hadoop2.7,相信大部分人都還不怎么了解,因此分享這篇文章給大家參考一下,希望大家閱讀完這篇文章后大有收獲,下面讓我們一起去了解一下吧!

總體思路,準備主從服務器,配置主服務器可以無密碼SSH登錄從服務器,解壓安裝JDK,解壓安裝Hadoop,配置hdfs、mapreduce等主從關系。

1、環境,3臺CentOS 7,64位,Hadoop2.7需要64位Linux,CentOS7 Minimal的ISO文件只有600M,操作系統十幾分鐘就可以安裝完成,

Master 192.168.0.182

Slave1 192.168.0.183

Slave2 192.168.0.184

2、SSH免密碼登錄,因為Hadoop需要通過SSH登錄到各個節點進行操作,我用的是root用戶,每臺服務器都生成公鑰,再合并到authorized_keys

(1)CentOS默認沒有啟動ssh無密登錄,去掉/etc/ssh/sshd_config其中2行的注釋,每臺服務器都要設置,

#RSAAuthentication yes

#PubkeyAuthentication yes

(2)輸入命令,ssh-keygen -t rsa,生成key,都不輸入密碼,一直回車,/root就會生成.ssh文件夾,每臺服務器都要設置,

(3)合并公鑰到authorized_keys文件,在Master服務器,進入/root/.ssh目錄,通過SSH命令合并,

cat id_rsa.pub>> authorized_keys

ssh root@192.168.0.183 cat ~/.ssh/id_rsa.pub>> authorized_keys

ssh root@192.168.0.184 cat ~/.ssh/id_rsa.pub>> authorized_keys

(4)把Master服務器的authorized_keys、known_hosts復制到Slave服務器的/root/.ssh目錄

(5)完成,ssh root@192.168.0.183、ssh root@192.168.0.184就不需要輸入密碼了

3、安裝JDK,Hadoop2.7需要JDK7,由于我的CentOS是最小化安裝,所以沒有OpenJDK,直接解壓下載的JDK并配置變量即可

(1)下載“jdk-7u79-linux-x64.gz”,放到/home/java目錄下

(2)解壓,輸入命令,tar -zxvf jdk-7u79-linux-x64.gz

(3)編輯/etc/profile

export JAVA_HOME=/home/java/jdk1.7.0_79

export CLASSPATH=.:$JAVA_HOME/jre/lib/rt.jar:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

export PATH=$PATH:$JAVA_HOME/bin

(4)使配置生效,輸入命令,source /etc/profile

(5)輸入命令,java -version,完成

4、安裝Hadoop2.7,只在Master服務器解壓,再復制到Slave服務器

(1)下載“hadoop-2.7.0.tar.gz”,放到/home/hadoop目錄下

(2)解壓,輸入命令,tar -xzvf hadoop-2.7.0.tar.gz

(3)在/home/hadoop目錄下創建數據存放的文件夾,tmp、hdfs、hdfs/data、hdfs/name

5、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下的core-site.xml

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.0.182:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/home/hadoop/tmp</value>

</property>

<property>

<name>io.file.buffer.size</name>

<value>131702</value>

</property>

</configuration>

6、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下的hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/home/hadoop/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/home/hadoop/dfs/data</value>

</property>

<property>

<name>dfs.replication</name>

<value>2</value>

</property>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>192.168.0.182:9001</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

</configuration>

7、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下的mapred-site.xml

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>192.168.0.182:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>192.168.0.182:19888</value>

</property>

</configuration>

8、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下的mapred-site.xml

<configuration>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.auxservices.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<property>

<name>yarn.resourcemanager.address</name>

<value>192.168.0.182:8032</value>

</property>

<property>

<name>yarn.resourcemanager.scheduler.address</name>

<value>192.168.0.182:8030</value>

</property>

<property>

<name>yarn.resourcemanager.resource-tracker.address</name>

<value>192.168.0.182:8031</value>

</property>

<property>

<name>yarn.resourcemanager.admin.address</name>

<value>192.168.0.182:8033</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address</name>

<value>192.168.0.182:8088</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>768</value>

</property>

</configuration>

9、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下hadoop-env.sh、yarn-env.sh的JAVA_HOME,不設置的話,啟動不了,

export JAVA_HOME=/home/java/jdk1.7.0_79

10、配置/home/hadoop/hadoop-2.7.0/etc/hadoop目錄下的slaves,刪除默認的localhost,增加2個從節點,

192.168.0.183

192.168.0.184

11、將配置好的Hadoop復制到各個節點對應位置上,通過scp傳送,

scp -r /home/hadoop 192.168.0.183:/home/

scp -r /home/hadoop 192.168.0.184:/home/

12、在Master服務器啟動hadoop,從節點會自動啟動,進入/home/hadoop/hadoop-2.7.0目錄

(1)初始化,輸入命令,bin/hdfs namenode -format

(2)全部啟動sbin/start-all.sh,也可以分開sbin/start-dfs.sh、sbin/start-yarn.sh

(3)停止的話,輸入命令,sbin/stop-all.sh

(4)輸入命令,jps,可以看到相關信息

13、Web訪問,要先開放端口或者直接關閉防火墻

(1)輸入命令,systemctl stop firewalld.service

(2)瀏覽器打開http://192.168.0.182:8088/

(3)瀏覽器打開http://192.168.0.182:50070/

14、安裝完成。這只是大數據應用的開始,之后的工作就是,結合自己的情況,編寫程序調用Hadoop的接口,發揮hdfs、mapreduce的作用。

=====================================================================================================================================

Hadoop是一個分布式系統基礎架構,他使得用戶可以在不了解分布式底層細節的情況下,開發分布式程序。

Hadoop的重要核心:HDFS和MapReduce。HDFS負責儲存,MapReduce負責計算。

下面介紹安裝Hadoop的重點:

其實安裝Hadoop也不麻煩,主要需要以下的幾點先行條件,如果以下先行條件弄好了,按照官網配置啟動就非常簡單了。

1、Java運行環境,建議Sun的發行版

2、SSH公鑰免密認證

以上環境搞定,剩下的就只是Hadoop的配置了,這部分配置不同版本或許有不同,詳細參照官方文檔說明。

環境

虛擬機:VMWare10.0.1 build-1379776

操作系統:CentOS7 64位

安裝Java環境

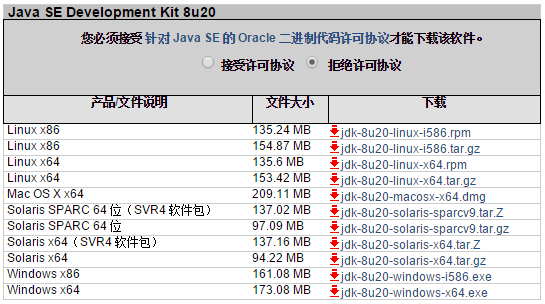

下載地址:http://www.Oracle.com/technetwork/cn/java/javase/downloads/jdk8-downloads-2133151-zhs.html

根據自己的操作系統版本選擇相應的下載包,如果是支持rpm包的,直接下載rpm,或者使用rpm地址

rpm –ivh http://download.oracle.com/otn-pub/java/jdk/8u20-b26/jdk-8u20-linux-x64.rpm

JDK會持續更新,所以安裝最新版本的JDK需要你自己去官網獲取最新安裝包的rpm地址。

配置SSH公鑰免密認證

CentOS中默認自帶了openssh-server、openssh-clients以及rsync,如果你的系統中沒有,那么請自行查找安裝方式。

創建共同的賬戶

所有機器上創建hadoop(名稱自定)賬戶,密碼也統一設置為hadoop

useradd -d /home/hadoop -s /usr/bin/bash –g wheel hadoop

passwd hadoop

SSH配置

vim /etc/ssh/sshd_config

找到如下三個配置項,并改成如下設置。如果被注釋了,就去掉前面的#解除注釋使配置生效。

RSAAuthentication yes

PubkeyAuthentication yes

# The default is to check both .ssh/authorized_keys and .ssh/authorized_keys2

# but this is overridden so installations will only check .ssh/authorized_keys

AuthorizedKeysFile .ssh/authorized_keys

.ssh/authorized_keys就是公鑰的存放路徑。

密鑰公鑰生成

用hadoop賬戶登錄。

cd ~

ssh-keygen –t rsa –P ''

將生成的~/.ssh/id_rsa.pub文件保存成~/.ssh/authorized_keys

cp ~/.ssh/id_rsa.pub ~/.ssh/authorized_keys

用scp命令將.ssh目錄拷貝到其他機器上,偷懶做法讓所有的機器的密鑰相同,共享公鑰。

scp ~/.ssh/* hadoop@slave1:~/.ssh/

注意保證~/.ssh/id_rsa的訪問權限必須是600,禁止其他用戶訪問。

以上是“CentOS 7如何安裝Hadoop2.7”這篇文章的所有內容,感謝各位的閱讀!相信大家都有了一定的了解,希望分享的內容對大家有所幫助,如果還想學習更多知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。