溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

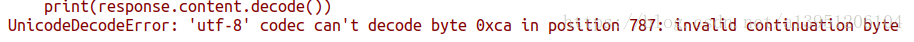

爬蟲部分解碼異常

response.content.decode() # 默認使用 utf-8 出現解碼異常

以下是設計的通用解碼

通過 text 獲取編碼

# 通過 text 獲取編碼

import requests

from lxml import etree

def public_decode():

headers = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36'

}

response = requests.get('https://blog.csdn.net/a13951206104', headers=headers)

html = etree.HTML(response.text) # response.text 能自動獲取編碼, 大多亂碼

_charset = html.xpath('//@charset') or []

if _charset:

encode_content = response.content.decode(_charset[0].strip().lower(),

errors='replace') # 如果設置為replace,則會用?取代非法字符;

return {'response_text': encode_content, "response_obj": response}

for _charset_ in ['utf-8', 'gbk', 'gb2312'] # 國內主要這3種:

if '�' not in response.content.decode(_charset_, errors='replace'):

return {'response_text': response.content.decode(_charset_, errors='replace'),

"response_obj": response}

else:

# 默認還得是 utf-8

return {'response_text': response.content.decode('utf-8', errors='replace'),

"response_obj": response}

通過數據 來解編碼(推薦)

def public_decode(response):

headers = {

'User-Agent': 'Mozilla/5.0 (Macintosh; Intel Mac OS X 10_15_1) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/78.0.3904.108 Safari/537.36'

}

response = requests.get('https://blog.csdn.net/a13951206104', headers=headers)

html = etree.HTML(response.text)

# 不希望抓下來的數據中有非法字符

item = dict()

result = None

for _charset_ in ['utf-8', 'gbk', 'gb2312']:

if response:

result = response.content.decode(_charset_, errors='replace')

item['content'] = html.xpath('//*[@id="content"]')

if '�' not in result['content'].strip():

result =response.content.decode(_charset_, errors='replace')

break

if not result:

# 默認 utf-8

result = response.content.decode(_charset_, errors='replace')

errors=‘replace' 使解碼不報異常, 然后把幾個常用的編碼一個個試下, 最后要看落下來的數據, 所以最好拿數據 去獲取合適的編碼

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。