您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

本篇主要講工作中的真實經歷,我們怎么打造億級日志平臺,同時手把手教大家建立起這樣一套億級 ELK 系統。日志平臺具體發展歷程可以參考上篇 「從 ELK 到 EFK 演進」

廢話不多說,老司機們座好了,我們準備發車了~~~

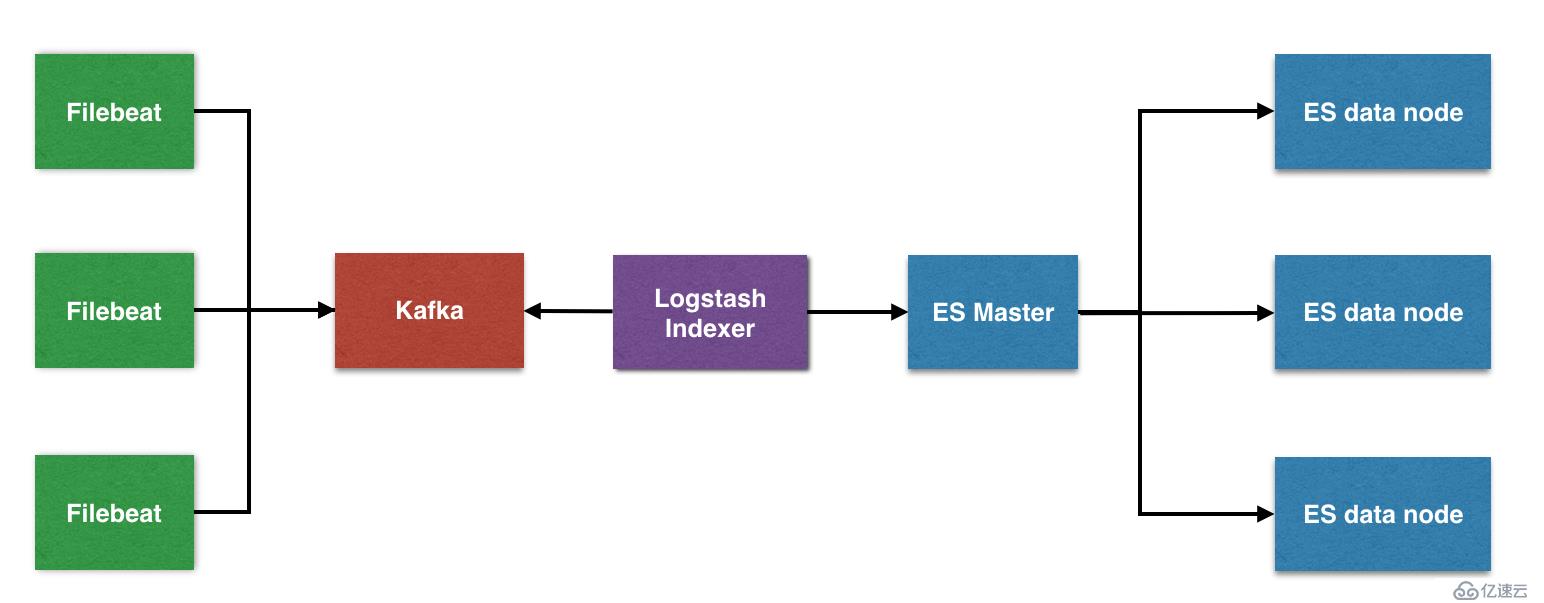

整體架構主要分為 4 個模塊,分別提供不同的功能

Filebeat:輕量級數據收集引擎。基于原先 Logstash-fowarder 的源碼改造出來。換句話說:Filebeat就是新版的 Logstash-fowarder,也會是 ELK Stack 在 Agent 的第一選擇。

Kafka: 數據緩沖隊列。作為消息隊列解耦了處理過程,同時提高了可擴展性。具有峰值處理能力,使用消息隊列能夠使關鍵組件頂住突發的訪問壓力,而不會因為突發的超負荷的請求而完全崩潰。

Logstash :數據收集處理引擎。支持動態的從各種數據源搜集數據,并對數據進行過濾、分析、豐富、統一格式等操作,然后存儲以供后續使用。

Elasticsearch :分布式搜索引擎。具有高可伸縮、高可靠、易管理等特點。可以用于全文檢索、結構化檢索和分析,并能將這三者結合起來。Elasticsearch 基于 Lucene 開發,現在使用最廣的開源搜索引擎之一,Wikipedia 、StackOverflow、Github 等都基于它來構建自己的搜索引擎。

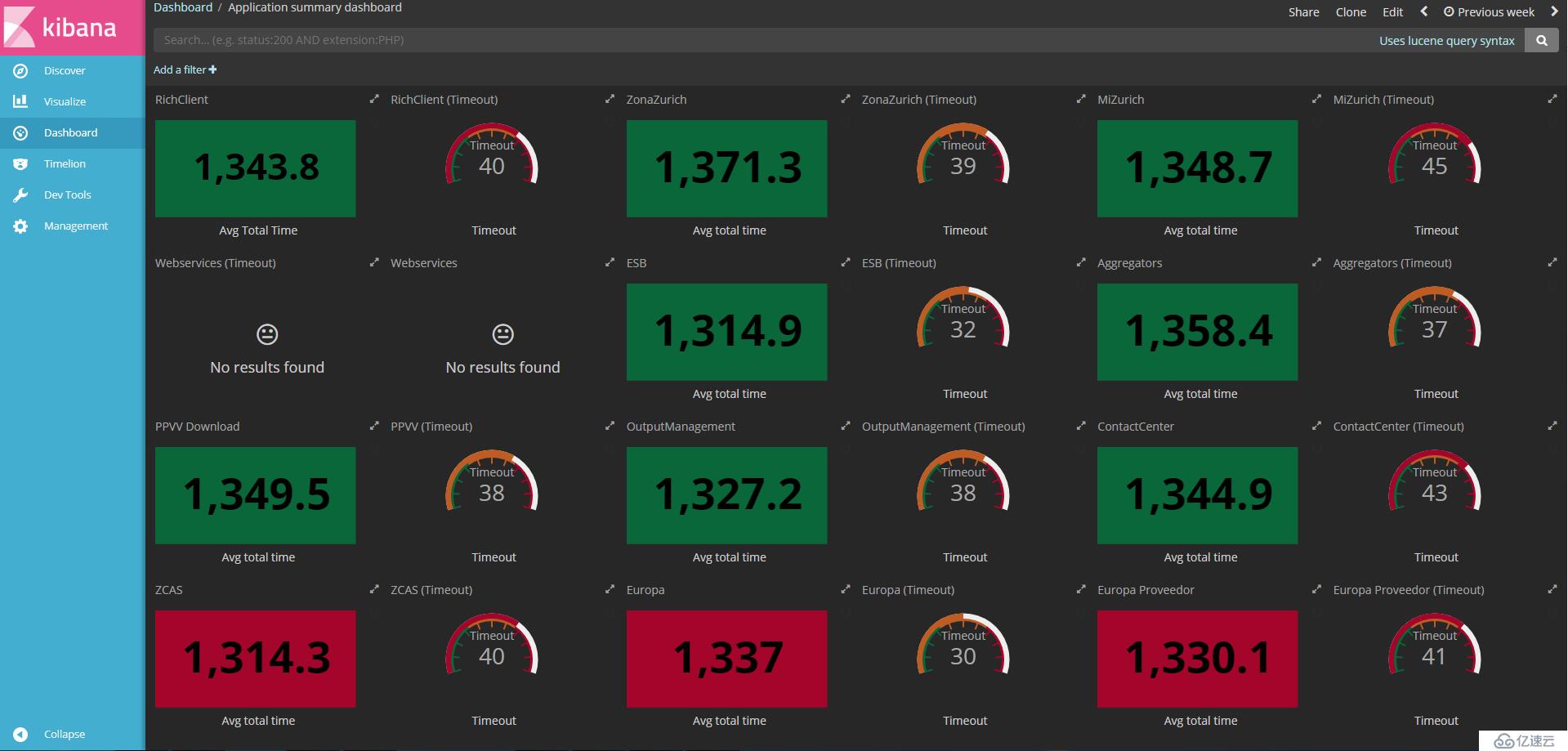

Kibana :可視化化平臺。它能夠搜索、展示存儲在 Elasticsearch 中索引數據。使用它可以很方便的用圖表、表格、地圖展示和分析數據。

Filebeat: 6.2.4

Kafka: 2.11-1

Logstash: 6.2.4

Elasticsearch: 6.2.4

Kibana: 6.2.4

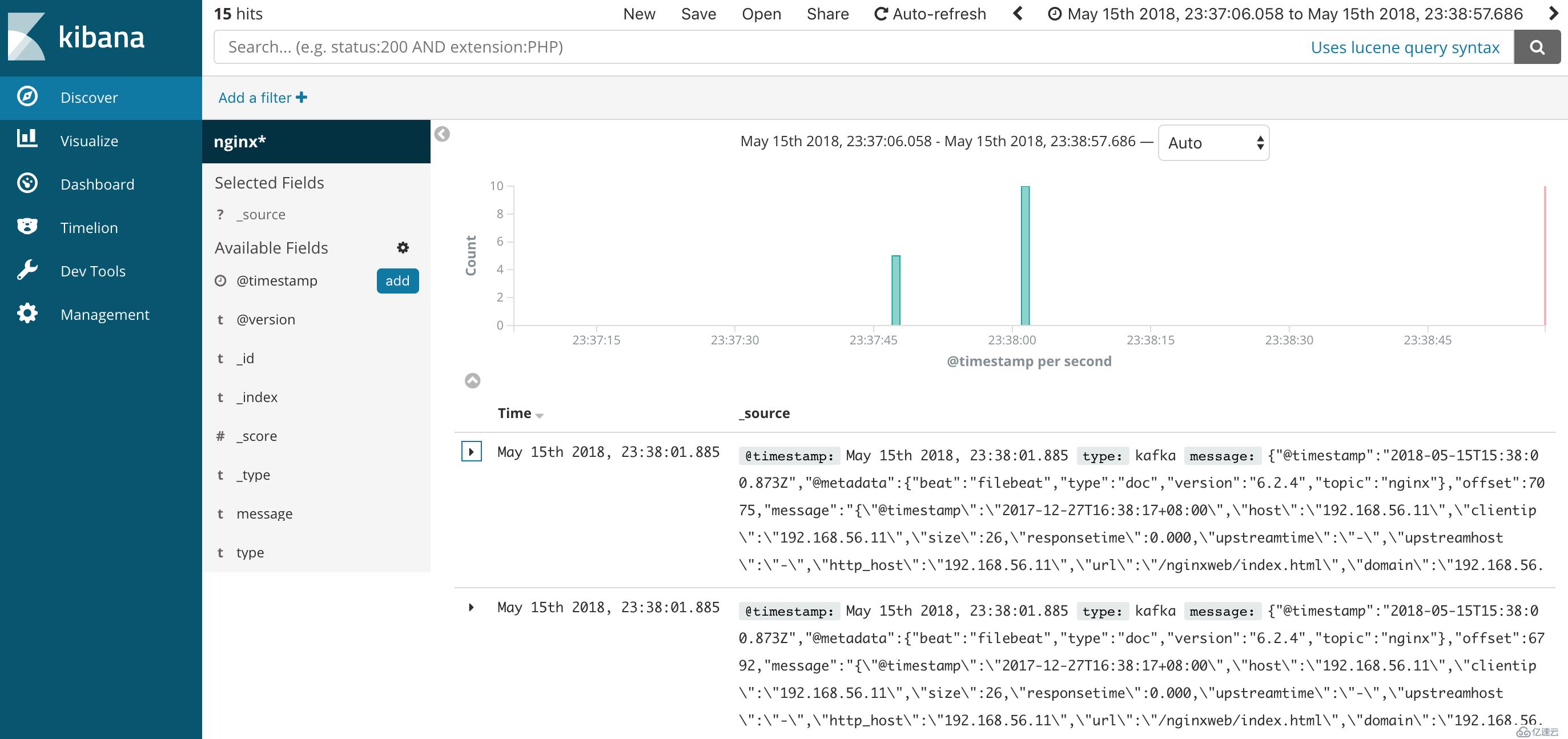

相應的版本最好下載對應的插件我們就以比較常見的 Nginx 日志來舉例說明下,日志內容是 JSON 格式

{"@timestamp":"2017-12-27T16:38:17+08:00","host":"192.168.56.11","clientip":"192.168.56.11","size":26,"responsetime":0.000,"upstreamtime":"-","upstreamhost":"-","http_host":"192.168.56.11","url":"/nginxweb/index.html","domain":"192.168.56.11","xff":"-","referer":"-","status":"200"}

{"@timestamp":"2017-12-27T16:38:17+08:00","host":"192.168.56.11","clientip":"192.168.56.11","size":26,"responsetime":0.000,"upstreamtime":"-","upstreamhost":"-","http_host":"192.168.56.11","url":"/nginxweb/index.html","domain":"192.168.56.11","xff":"-","referer":"-","status":"200"}

{"@timestamp":"2017-12-27T16:38:17+08:00","host":"192.168.56.11","clientip":"192.168.56.11","size":26,"responsetime":0.000,"upstreamtime":"-","upstreamhost":"-","http_host":"192.168.56.11","url":"/nginxweb/index.html","domain":"192.168.56.11","xff":"-","referer":"-","status":"200"}

{"@timestamp":"2017-12-27T16:38:17+08:00","host":"192.168.56.11","clientip":"192.168.56.11","size":26,"responsetime":0.000,"upstreamtime":"-","upstreamhost":"-","http_host":"192.168.56.11","url":"/nginxweb/index.html","domain":"192.168.56.11","xff":"-","referer":"-","status":"200"}

{"@timestamp":"2017-12-27T16:38:17+08:00","host":"192.168.56.11","clientip":"192.168.56.11","size":26,"responsetime":0.000,"upstreamtime":"-","upstreamhost":"-","http_host":"192.168.56.11","url":"/nginxweb/index.html","domain":"192.168.56.11","xff":"-","referer":"-","status":"200"}為什么用 Filebeat ,而不用原來的 Logstash 呢?

原因很簡單,資源消耗比較大。

由于 Logstash 是跑在 JVM 上面,資源消耗比較大,后來作者用 GO 寫了一個功能較少但是資源消耗也小的輕量級的 Agent 叫 Logstash-forwarder。

后來作者加入 elastic.co 公司, Logstash-forwarder 的開發工作給公司內部 GO 團隊來搞,最后命名為 Filebeat。

Filebeat 需要部署在每臺應用服務器上,可以通過 Salt 來推送并安裝配置。

$ wget https://artifacts.elastic.co/downloads/beats/filebeat/filebeat-6.2.4-darwin-x86_64.tar.gztar -zxvf filebeat-6.2.4-darwin-x86_64.tar.gz

mv filebeat-6.2.4-darwin-x86_64 filebeat

cd filebeat修改 Filebeat 配置,支持收集本地目錄日志,并輸出日志到 Kafka 集群中

$ vim fileat.yml

filebeat.prospectors:

- input_type: log

paths:

- /opt/logs/server/nginx.log

json.keys_under_root: true

json.add_error_key: true

json.message_key: log

output.kafka:

hosts: ["192.168.0.1:9092,192.168.0.2:9092,192.168.0.3:9092"]

topic: 'nginx'

Filebeat 6.0 之后一些配置參數變動比較大,比如 document_type 就不支持,需要用 fields 來代替等等。

$ ./filebeat -e -c filebeat.yml

生產環境中 Kafka 集群中節點數量建議為(2N + 1 )個,這邊就以 3 個節點舉例

直接到官網下載 Kafka

$ wget http://mirror.bit.edu.cn/apache/kafka/1.0.0/kafka_2.11-1.0.0.tgztar -zxvf kafka_2.11-1.0.0.tgz

mv kafka_2.11-1.0.0 kafka

cd kafka修改 Zookeeper 配置,搭建 Zookeeper 集群,數量 ( 2N + 1 ) 個

ZK 集群建議采用 Kafka 自帶,減少網絡相關的因素干擾

$ vim zookeeper.properties

tickTime=2000

dataDir=/opt/zookeeper

clientPort=2181

maxClientCnxns=50

initLimit=10

syncLimit=5

server.1=192.168.0.1:2888:3888

server.2=192.168.0.2:2888:3888

server.3=192.168.0.3:2888:3888

Zookeeper data 目錄下面添加 myid 文件,內容為代表 Zooekeeper 節點 id (1,2,3),并保證不重復

$ vim /opt/zookeeper/myid

1

分別啟動 3 臺 Zookeeper 節點,保證集群的高可用

$ ./zookeeper-server-start.sh -daemon ./config/zookeeper.propertieskafka 集群這邊搭建為 3 臺,可以逐個修改 Kafka 配置,需要注意其中 broker.id 分別 (1,2,3)

$ vim ./config/server.properties

broker.id=1

port=9092

host.name=192.168.0.1

num.replica.fetchers=1

log.dirs=/opt/kafka_logs

num.partitions=3

zookeeper.connect=192.168.0.1: 192.168.0.2: 192.168.0.3:2181

zookeeper.connection.timeout.ms=6000

zookeeper.sync.time.ms=2000

num.io.threads=8

num.network.threads=8

queued.max.requests=16

fetch.purgatory.purge.interval.requests=100

producer.purgatory.purge.interval.requests=100

delete.topic.enable=true分別啟動 3 臺 Kafka 節點,保證集群的高可用

$ ./bin/kafka-server-start.sh -daemon ./config/server.properties查看 topic 是否創建成功

$ bin/kafka-topics.sh --list --zookeeper localhost:2181

nginx

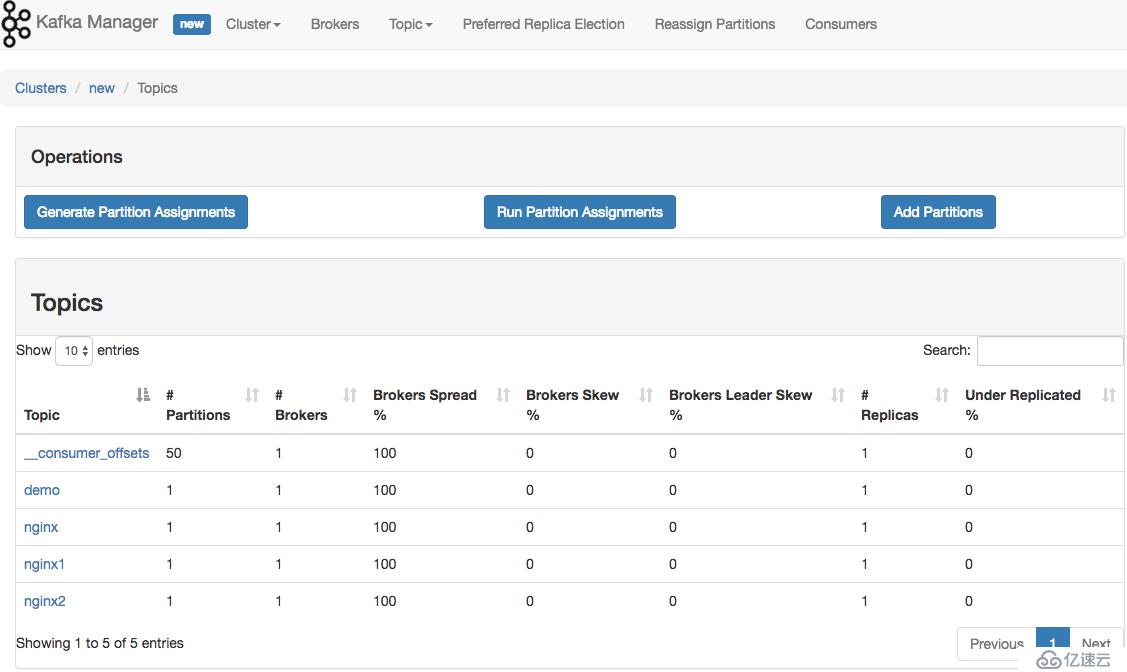

Kafka-manager 是 Yahoo 公司開源的集群管理工具。

可以在 Github 上下載安裝:https://github.com/yahoo/kafka-manager

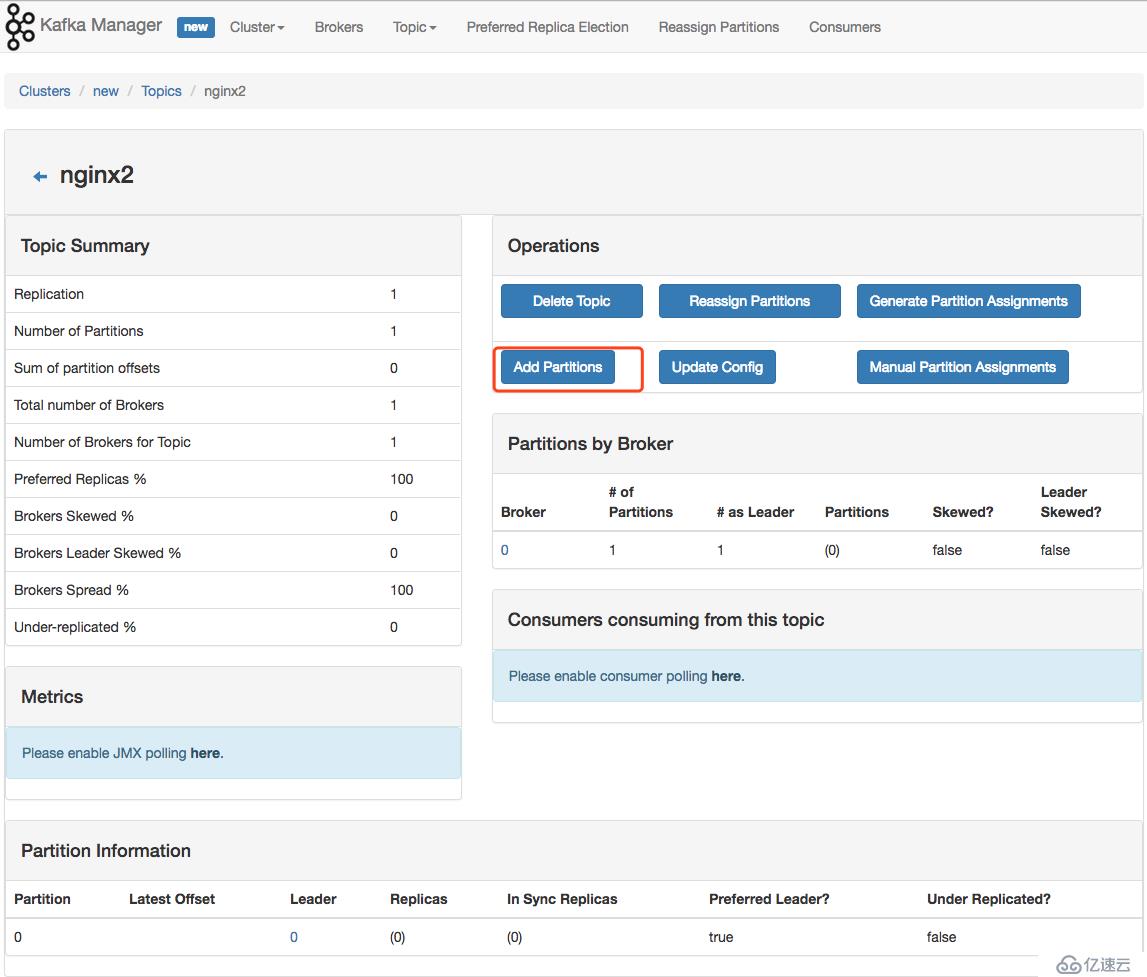

如果遇到 Kafka 消費不及時的話,可以通過到具體 cluster 頁面上,增加 partition。Kafka 通過 partition 分區來提高并發消費速度

Logstash 提供三大功能

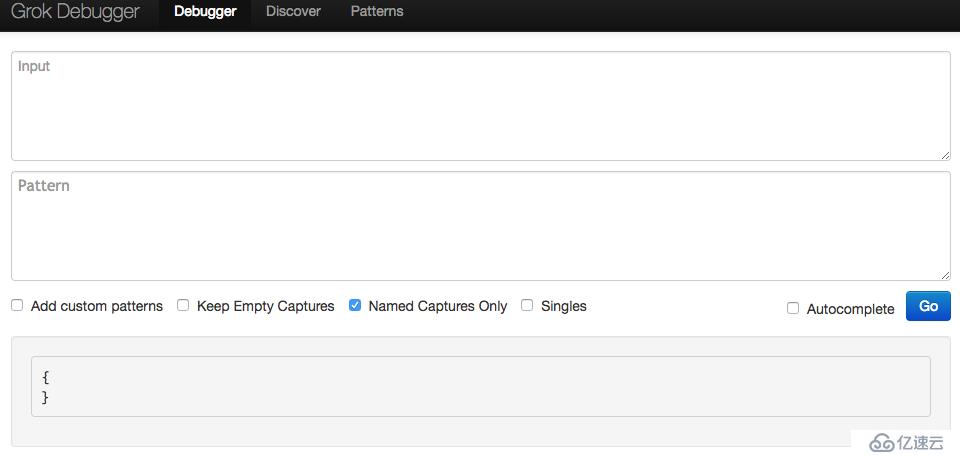

如果使用 Filter 功能的話,強烈推薦大家使用 Grok debugger 來預先解析日志格式。

$ wget https://artifacts.elastic.co/downloads/logstash/logstash-6.2.4.tar.gz$ tar -zxvf logstash-6.2.4.tar.gz

$ mv logstash-6.2.4 logstash修改 Logstash 配置,使之提供 indexer 的功能,將數據插入到 Elasticsearch 集群中

$ vim nginx.conf

input {

kafka {

type => "kafka"

bootstrap_servers => "192.168.0.1:2181,192.168.0.2:2181,192.168.0.3:2181"

topics => "nginx"

group_id => "logstash"

consumer_threads => 2

}

}

output {

elasticsearch {

host => ["192.168.0.1","192.168.0.2","192.168.0.3"]

port => "9300"

index => "nginx-%{+YYYY.MM.dd}"

}

}$ ./bin/logstash -f nginx.conf$ wget https://artifacts.elastic.co/downloads/elasticsearch/elasticsearch-6.2.4.tar.gz$ tar -zxvf elasticsearch-6.2.4.tar.gz

$ mv elasticsearch-6.2.4.tar.gz elasticsearch$ vim config/elasticsearch.yml

cluster.name: es

node.name: es-node1

network.host: 192.168.0.1

discovery.zen.ping.unicast.hosts: ["192.168.0.1"]

discovery.zen.minimum_master_nodes: 1通過 -d 來后臺啟動

$ ./bin/elasticsearch -d打開網頁 http://192.168.0.1:9200/, 如果出現下面信息說明配置成功

{

name: "es-node1",

cluster_name: "es",

cluster_uuid: "XvoyA_NYTSSV8pJg0Xb23A",

version: {

number: "6.2.4",

build_hash: "ccec39f",

build_date: "2018-04-12T20:37:28.497551Z",

build_snapshot: false,

lucene_version: "7.2.1",

minimum_wire_compatibility_version: "5.6.0",

minimum_index_compatibility_version: "5.0.0"

},

tagline: "You Know, for Search"

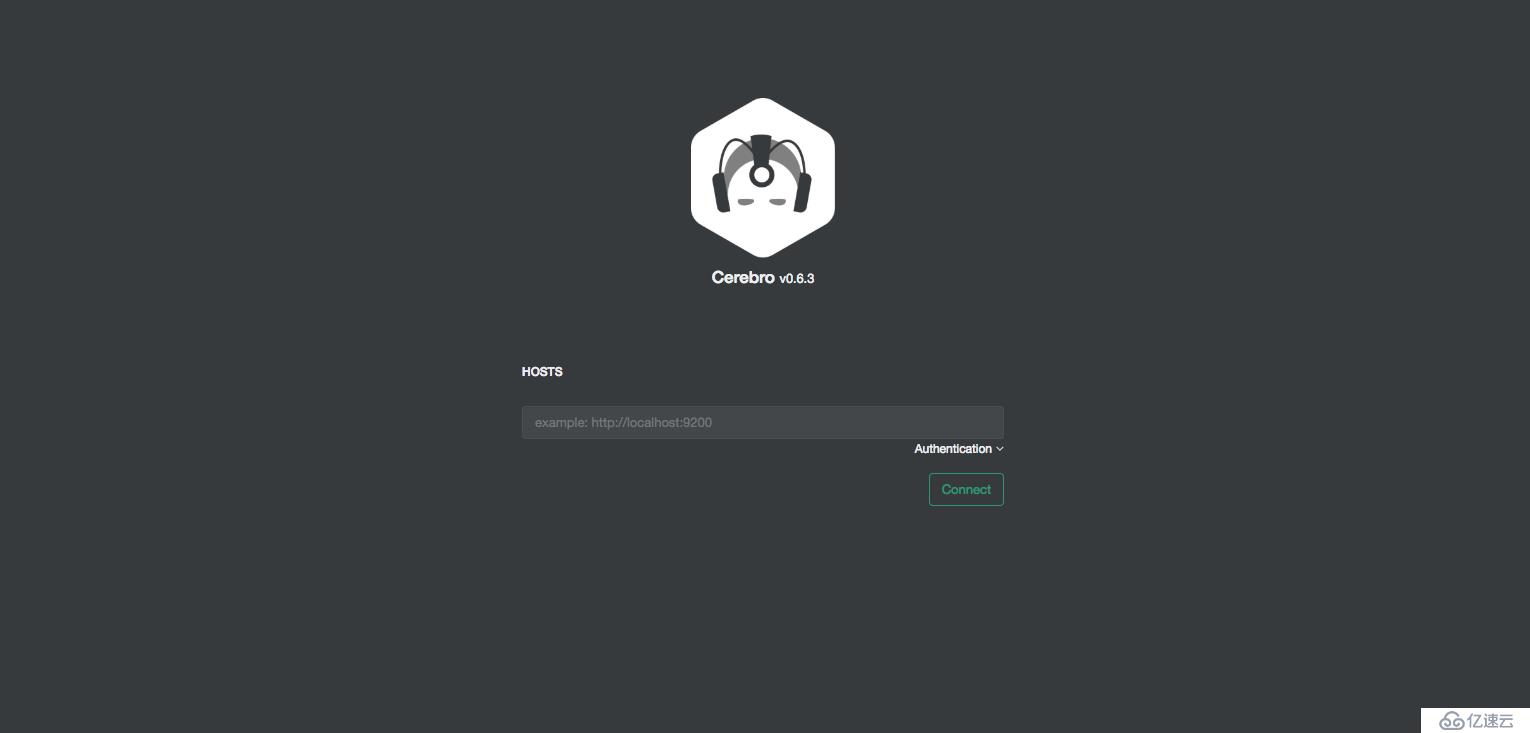

}Cerebro 這個名字大家可能覺得很陌生,其實過去它的名字叫 kopf !因為 Elasticsearch 5.0 不再支持 site plugin,所以 kopf 作者放棄了原項目,另起爐灶搞了 cerebro,以獨立的單頁應用形式,繼續支持新版本下 Elasticsearch 的管理工作。

$ wget https://artifacts.elastic.co/downloads/kibana/kibana-6.2.4-darwin-x86_64.tar.gz$ tar -zxvf kibana-6.2.4-darwin-x86_64.tar.gz

$ mv kibana-6.2.4-darwin-x86_64.tar.gz kibana$ vim config/kibana.yml

server.port: 5601

server.host: "192.168.0.1"

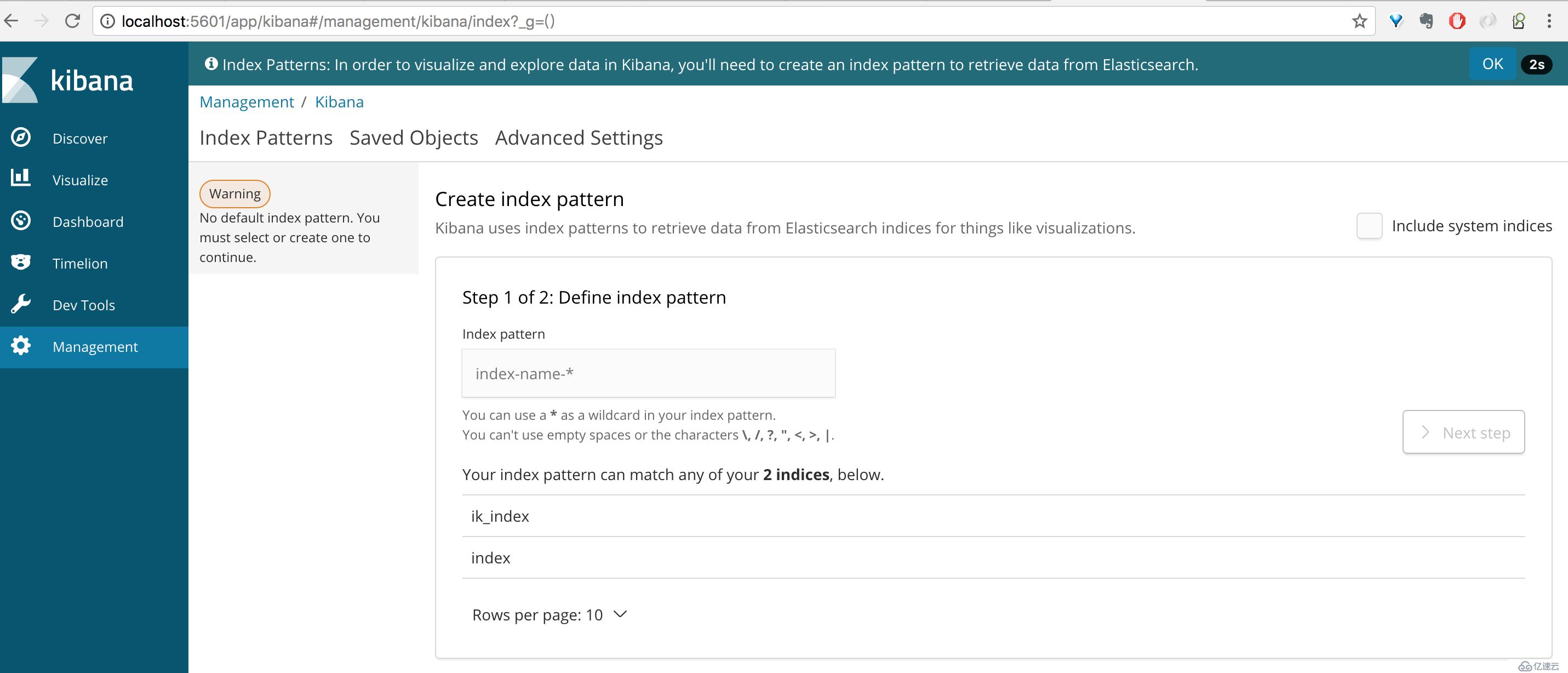

elasticsearch.url: "http://192.168.0.1:9200"$ nohup ./bin/kibana &創建索引頁面需要到 Management -> Index Patterns 中通過前綴來指定

綜上,通過上面部署命令來實現 ELK 的整套組件,包含了日志收集、過濾、索引和可視化的全部流程,基于這套系統實現分析日志功能。同時,通過水平擴展 Kafka、Elasticsearch 集群,可以實現日均億級的日志實時處理。

所有好的架構設計首要的原則并不是追求先進,而是合理性,要與公司的業務規模和發展趨勢相匹配,任何一個公司,哪怕是現在看來規模非常大的公司,比如 BAT 之類,在一開始,其系統架構也應簡單和清晰的。

但隨著業務范圍不斷擴充,業務規模不斷擴大,系統漸進復雜和龐大,讓所有系統都遇到高可用的問題。那我們該如何避免類似的問題,構建高可用系統呢?

為此我特意寫了一個專欄《帶你玩轉高可用》,將多年來在百度和滬江的架構設計實戰經驗,集結成這個專欄。

本專欄總共包含 15 篇文章,分成三大模塊詳細解釋高可用架構的相關知識:

概念篇:介紹高可用架構理論與演進,這塊比較偏理論。不過對于我們理解整套體系還是有必須的。

工程篇:介紹常見互聯網分層中每一層高可用是怎么做的,包含 DNS、服務層、緩存層、數據層等

問題篇:介紹怎么排查線上常用的故障,包括機器、應用層等維度故障定位

專欄每周都會更新,持續 64 天。在這將近 2 個月內,我會帶著大家去全面了解高可用架構的方方面面,同時會將遇到的這些問題和對應的解決方案拋出來,希望大家不要重復我遇到過的坑。同時也期待大家提出有意思的問題。

專欄地址:帶你玩轉高可用

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。